如何通过移动代理根据地区收集竞争对手的语义核心:逐步指南

引言

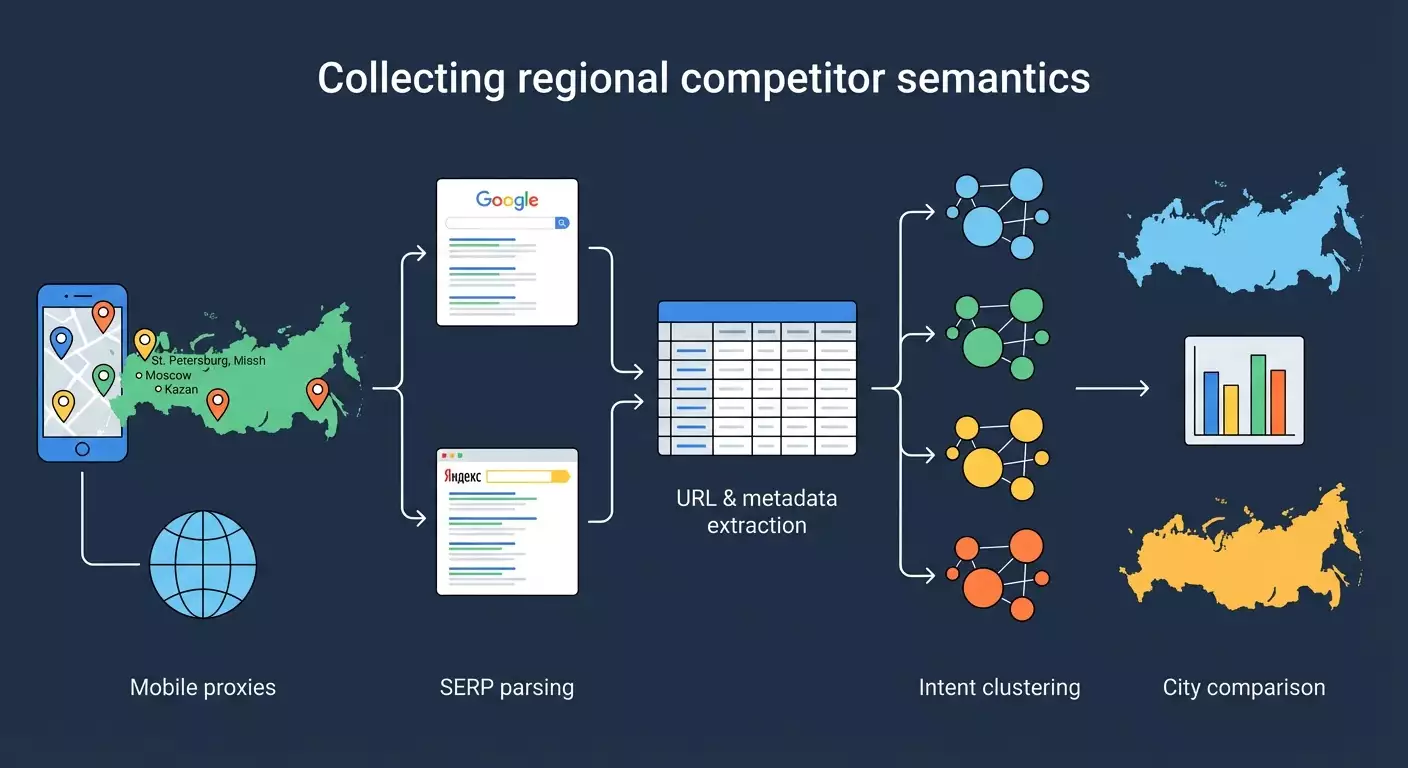

在这个逐步指南中,您将学习如何使用移动代理在俄罗斯不同地区收集竞争对手的语义核心,抓取Google和Yandex的搜索结果,以及分组和分析工具。我们将从零开始:环境准备、按城市设置代理、抓取目标请求的前50名结果、提取URL、标题、描述、排名、按意图(信息性、商业性、导航性)聚类收集的语义、比较地区结果并为SEO解决方案准备实用报告。

最终,您将获得:1)每个城市的竞争对手列表,2)竞争对手在不同地区排名的关键词表,3)地区结果和请求本地化的差异指标,4)按意图分组的集群,以节省预算和优先考虑内容,5)可每月运行的可重复流程。

本指南适合SEO专家、网络营销人员、分析师以及希望了解地区结果如何运作的人。难度级别适合初学者,同时也有进阶内容。我们不会要求深入的编程技能,但一些Python的基本操作将是有用的。

您需要提前了解的内容:对SEO的基本了解、摘要是如何生成的、信息请求和商业请求有什么区别、如何使用CSV/Excel。预计需要的时间:在已经准备好的请求和城市列表的情况下,首次启动需要6-10小时,后续迭代需要1-3小时。

✅ 检查: 您了解将获得具体的城市竞争对手列表、整体和独特的语义,并能够解释哪些请求是本地化的,以及如何在地区SEO中使用它。

前期准备

所需工具:1)在mobileproxy.space注册账户并获得俄罗斯城市(莫斯科、圣彼得堡、叶卡捷琳堡、新西伯利亚、喀山等)的移动代理。2)Python 3.10以上和包管理工具pip。3)Python库:requests, beautifulsoup4, lxml, pandas, urllib3, tldextract(用于提取域名)。4)文本编辑器(VS Code或类似)。5)表格编辑器(Excel、Google Sheets或LibreOffice Calc)。6)Windows上的Key Collector用于请求的分组和聚类。7)终端或命令提示符。8)可选:curl用于快速检查代理。9)访问浏览器以使用Yandex.Internetometer验证地理位置(Yandex提供的IP地理位置检查网站)。

系统要求:Windows 10/11或macOS 12以上或Linux(Ubuntu 22.04以上),至少8GB RAM,稳定的互联网连接10Mbps以上,磁盘上有2-5GB的空闲空间用于数据和日志。

需要安装的内容:1)安装最新稳定版本的Python。2)在Windows上安装Key Collector。3)在mobileproxy.space创建账户,充值并购买您所需城市的代理(每个城市1个代理,最好购买2-3个以分配负载)。4)安装库:在终端中执行:pip install requests beautifulsoup4 lxml pandas urllib3 tldextract。5)配置文本编辑器和终端。

备份创建:创建一个项目文件夹,包含子文件夹data/raw、data/clean、reports、config、logs,并定期将CSV文件复制到备份文件夹或云端。

⚠️ 注意: 确保您的行为符合法律和服务条款。一些搜索引擎限制自动数据抓取。请合理限制请求次数,阅读robots.txt,遵循规则,并考虑将官方API作为优先方法。

建议: 创建Python虚拟环境(python -m venv .venv并激活它),并在requirements.txt中锁定依赖项,以方便项目的移植。

✅ 检查: 终端中的命令python --version和pip --version可以正常工作,库安装无误,您至少拥有一个可以用于莫斯科的代理,并且可以在浏览器中打开Yandex.Internetometer。

基本概念

简单语言描述的关键术语:1)语义核心——您希望排名或分析竞争对手的搜索请求清单。2)地区结果——根据用户位置(城市、地区)生成的搜索结果。3)移动代理——基于移动运营商的代理服务器,可以模拟来自真实移动IP地址的流量,更重要的是可以选择城市。4)抓取SERP——从搜索结果页中提取数据(URL、标题、摘要、位置)。5)意图——用户的预期目标:信息性(获取信息)、商业性(购买/订购)、导航性(查找特定网站)。6)前50名——前50个有机结果,不包括广告。

主要工作原理:我们向搜索引擎发送请求,指定代理以固定地理位置,获取HTML页面,提取所需要素,然后将其保存到表中。对每个城市和每个请求重复此过程。然后进行分组和分析。

重要理解:1)不同城市的顶级域和页面可能会有所不同。2)本地化请求通常包含城市名称或暗示本地意图(例如,送货、附近、地址)。3)频繁的请求没有间隔可能会导致验证码或被阻止。4)正确检查地理位置至关重要。5)部分结果可能会个性化;请使用干净会话,无需身份验证。

建议: 在分析时,不仅要关注关键词,还要关注竞争对手的域名和内容类型,以便选择正确的策略(本地页面、目录、文章、着陆页)。

步骤1:确定目标请求和地区列表

阶段目的

创建要抓取结果的初始请求列表和城市列表。这是抓取和比较的基础。

逐步指南

- 打开电子表格(Excel或Google Sheets)并创建Seeds工作表。

- 在A列列出反映您产品或领域的基本请求。例如:“送水”、“笔记本电脑维修”、“购买家具”等。

- 在B列添加重要的细化或同义词。例如:“饮用水”、“MacBook维修”、“衣柜”。

- 创建Cities工作表。在A列列出城市:莫斯科、圣彼得堡、叶卡捷琳堡、新西伯利亚、喀山、下诺夫哥罗德、萨马拉、车里雅宾斯克、鄂木斯克、罗斯托夫及其他目标地区。

- 确定优先级:选出10-15个需求最大的关键城市。

- 生成目标请求列表,将基本请求和细化请求合并。例如:“送水”、“送水到家”、“饮用水送货”、“笔记本电脑维修”、“紧急笔记本电脑维修”。

- 将电子表格保存到data/raw文件夹,命名为seeds_and_cities.xlsx。

重要事项: 暂时不要在请求中添加城市名称,以便在没有明显地理标识的情况下评估本地化。您可以稍后检查带有地理修饰符的请求。

建议: 将列表限制为50-200个请求,以便于首次启动,不要给代理造成过多负担,也不要浪费时间。

✅ 检查: 您有一个包含50-200个请求和10-15个城市的文件。请求清晰并符合业务目标。

可能的问题及解决方案:如果很难生成列表,可以从您网站的内部搜索提示、与客户的聊天记录、服务和产品类别列表中获取数据。然后手动扩大提示。

步骤2:按城市设置移动代理并确认地理位置

阶段目的

连接mobileproxy.space中的移动代理,以便为每个城市检查IP是否确实对应于所需城市,使用Yandex.Internetometer进行验证。

逐步指南

- 登录mobileproxy.space账户。选择可以选择城市和运营商的套餐。为列表中的每个城市购买至少一个代理。最佳选择是每个城市2-3个代理。

- 记录每个代理的信息:主机、端口、用户名和密码。例如:proxy.example.host:12345, user:pass。

- 如果支持按链接或API进行轮换,请保存链接以更换IP。这将有助于在出现验证码时重置会话。

- 创建config/proxies.csv文件,其中包含城市、主机、端口、用户、密码、轮换URL(如果有)的列,并填写相应信息。

- 打开浏览器,启用系统代理或浏览器代理,将其设置为莫斯科,并访问Yandex提供的IP和地理位置检查服务(Yandex.Internetometer)。确保定位城市为莫斯科。

- 对圣彼得堡、叶卡捷琳堡和其他城市重复检查,切换代理设置。

- 在浏览器中禁用代理。往后我们将以编程方式进行地理位置检查。

⚠️ 注意: 仅应根据服务条款和法律使用代理。代理的目的是正确固定地理位置并均匀分配负载,而不是规避限制。

建议: 创建一个简单的超时设置:更换代理后等待10-20秒再检查地理位置,以避免“缓存”或网络延迟。

✅ 检查: 对于每个城市,您可以启用相应的代理,并在Yandex.Internetometer中看到正确的城市。

可能遇到的问题及解决方案:如果城市识别错误,尝试通过轮换更换IP,选择同一城市的其他运营商,或联系支持。如果浏览器忽略代理,请检查设置和授权。

步骤3:准备Python环境和项目结构

阶段目的

创建一个稳定的抓取和分析环境:目录结构、依赖项、通过代理测试连接。

逐步指南

- 创建项目文件夹,例如regional-serp-competitors。

- 在内部创建子文件夹:config、data/raw、data/clean、logs、reports、scripts。

- 创建虚拟环境:在终端执行“python -m venv .venv”并激活它(Windows:“.venv\Scripts\activate”,macOS/Linux:“source .venv/bin/activate”)。

- 安装依赖项:“pip install requests beautifulsoup4 lxml pandas urllib3 tldextract”。

- 创建config/settings.yaml文件。写入基本参数:超时、延迟(例如delay_min: 3, delay_max: 8)、最大重试次数(retries: 3)、用户代理。

- 创建scripts/test_proxy_geo.py脚本,该脚本将通过其中一个代理加载Yandex.Internetometer页面,并输出HTML中确定的城市。

- 在脚本中将代理设置为字典格式:{"http": "http://user:pass@host:port", "https": "http://user:pass@host:port"},并对IP检查页面执行requests.get请求,提取包含该城市的HTML节点(按“城市”文本或类似元素)。

- 对多个城市运行该脚本,确保输出符合预期。

建议: 设置统一的User-Agent,例如“Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/121.0 Safari/537.36”,并在每20-50个请求中按需更换。

✅ 检查: test_proxy_geo.py脚本在更换代理时正确输出不同城市。在日志中没有持续的超时和授权错误。

可能遇到的问题及解决方案:如果requests收到407 Proxy Authentication Required,请检查用户名和密码、字符转义。如果遇到验证码,请增加延迟并更慢和平稳地启用IP轮换。

步骤4:为每个地区编制直接竞争对手列表

阶段目的

确定每个城市的竞争对手域名,以便随后跟踪它们的排名和收集语义。

逐步指南

- 在您的列表中选择5-10个关键请求,这些请求能准确反映目标服务或产品,而不带地理细节。

- 创建scripts/collect_competitors.py脚本。为每个城市选择相应的代理。依次对所选请求在Yandex和Google上进行搜索。

- 对于Yandex,请使用考虑语言和地区的请求参数。例如,如果您知道lr(地区代码),请添加lr,否则请依赖代理地理位置。

- 对于Google,请设置参数hl=ru,gl=ru。地理位置将通过IP获得;您还可以测试安全搜索参数。

- 提取前20-30个有机结果。跳过广告块、服务和无关的工具,如果这些不符合目标。

- 使用tldextract规范化域名。为每个城市记录域名的频率:域名、出现在顶级中的次数、对应的请求。

- 生成表格data/raw/competitors_by_city.csv,包含城市、域名、搜索引擎、频率、请求的列。

重要事项: 个性化服务(地图、市集)可能占主导地位。如果它们在结果中是真正的竞争者,请保留它们。如果您是B2B,请过滤新闻聚合器。

建议: 对每个城市的1-2条请求创建“手工检查”,在您的浏览器中通过相应的代理手动检查并与脚本结果中的域名进行比较。这将提高抓取准确性的信心。

✅ 检查: 每个城市都有10-30个域名列表,附带频率指标。结果中包含本地网站和全国性参与者。来自脚本的数据接近手动检查。

问题与解决方案:与手动检查的差异可能由于结果波动、个性化或广告块筛选不当而导致。增加延迟,使用干净会话和额外检查。

步骤5:抓取请求和城市的前50个结果(Google和Yandex)

阶段目的

收集详细的结果表:URL、标题、描述、位置、搜索引擎、城市、请求。

逐步指南

- 创建scripts/serp_scraper.py脚本。结构:对Yandex和Google的请求函数、HTML解析函数、将行保存到CSV中。

- 创建包含参数的配置文件:每个城市每个查询的结果数量per_city_per_query_limit: 50、延迟delay_min、delay_max、最大重试次数retries: 3、用户代理字符串列表。

- 构造搜索URL。例如Google:“https://www.google.com/search?q=请求&num=50&hl=ru&gl=ru&pws=0”。Yandex示例:“https://yandex.ru/search/?text=请求&lr=地区代码&numdoc=50”,如果lr未知,请基于IP地理位置进行查询。

- 按城市设置代理。代理字典:{"http": "http://user:pass@host:port", "https": "http://user:pass@host:port"}。

- 请求页面时超时设置为20-30秒。处理错误:超时、429、5xx。如果遇到错误,请暂停30-60秒后用相同代理重试。

- 抓取Google时:查找结果容器:h3标签的区块用于标题和链接,snippets在相邻的div/span中。排除与缓存、图片、视频、广告无关的链接。如果结构不同,使用所有找到的“a”标签,过滤域名。

- 抓取Yandex时:查找有机结果的卡片。提取“a”链接、标题和提示文本。如果不在分析中,则排除工具(例如地图、目录),否则标记为type=feature。

- 顺序编号的位置,从1到50。对于Yandex和Google的结果,位置是在有机卡片中计算的。

- 保存带有以下列的行:engine、city、query、position、url、title、snippet、fetched_at(日期时间)、proxy_id。

- 对城市按顺序启动抓取。对于每个城市遍历所有请求。在请求之间延迟3-8秒,城市之间延迟10-20秒。

- 将数据保存到data/raw/serp_results.csv。每小时复制一次备份,文件名前加日期前缀。

⚠️ 注意: 部分搜索引擎不允许自动抓取。考虑使用官方API(例如 Google Custom Search API)或专业服务。如果您抓取HTML,请谨慎且尽量减少,仅用于分析目的,遵循限制。

建议: 尽量在清晨或深夜抓取,以降低负载。随机的暂停和轮换用户代理可以降低验证码的概率。

✅ 检查: 最终CSV文件中应有每个城市和请求的记录,每个组合50条结果。字段已填充,URL正确,位置按顺序排列。

问题与解决方案:如果遇到验证码,增加暂停,减少同时请求数,每2-5分钟轮换IP。如果HTML结构发生变化,请更新选择器并加快手动检查步伐。

步骤6:清理、规范化和提取域名

阶段目的

准备数据以进行分析:清除垃圾、规范化URL、提取域名、排除不相关元素。

逐步指南

- 使用pandas加载CSV(脚本scripts/clean_results.py)。检查是否有空的标题/片段,并在必要时从HTML的其他节点恢复。

- 根据(engine、city、query、url)筛选重复行。保留首次出现的记录。

- 排除搜索引擎的内部链接、缓存重定向,移除地图或新闻链接,如果这些不需要。为纯有机结果添加type=organic标记。

- 规范化URL:删除锚点,将方案转换为https,去除跟踪参数(utm_*、gclid等)。将清理后的URL保存在新的列clean_url中。

- 使用tldextract获得二级域和区域,保存在root_domain列中,例如“site.ru”。

- 将清理后的文件保存到data/clean/serp_results_clean.csv。

建议: 立即为地图/目录/市场类型的结果添加is_local_feature列,以便在分析中快速区分它们与普通页面。

✅ 检查: 由于删除重复项和垃圾数据,行数减少,域名得以成功提取,没有服务链接。您可以计算每个城市和请求的唯一root_domain。

问题与解决方案:如果垃圾标记的结果过多,请检查筛选条件并澄清规则。有时保留大型聚合服务以保持分析完整性是有用的。

步骤7:按意图对收集到的语义进行聚类

阶段目的

将关键短语按意图和主题集群分组,以了解进行地区推广所需的内容和页面类型。

逐步指南

- 从抓取数据中生成唯一请求列表:提取query列并删除重复项。保存到data/clean/unique_queries.csv。

- 在Windows上打开Key Collector并创建新项目:文件 → 新建项目。输入项目名称,例如“地区SERP竞争者”。

- 导入请求列表:菜单导入 → 从文件 → 选择unique_queries.csv。确保编码为UTF-8。

- 按主题创建组。在Key Collector中使用基于形态或共同词汇的聚类工具。可以从中等相似度阈值(例如3个共同术语)开始,然后手动调整组。

- 为每组标记意图:信息性、商业性、导航性。您可以创建自定义字段。示例:信息性——“如何选择”、“什么是”;商业性——“价格”、“购买”、“订购”;导航性——“品牌”、“官方网站”。

- 将结果导出为CSV,列包含query、cluster、intent。保存到data/clean/queries_clustered.csv。

建议: 如果没有Key Collector,您可以在pandas中编写简单的启发式方法:为每个意图创建单词提示列表,并根据这些单词的出现对请求进行分类。然后手动检查有争议的案例。

✅ 检查: 每个请求都有对应的集群和意图。大多数商业请求逻辑上被合理地聚类,信息请求和交易请求分别隔离。

可能遇到的问题及解决方案:如果组过于宽泛,请降低相似度阈值。如果过于狭窄,请提高阈值或手动合并。对于复杂主题,混合方法通常有效:自动初步聚类+手动调整。

步骤8:合并数据并准备分析切片

阶段目的

将SERP结果与聚类结合,计算出用于比较分析的有用指标,涵盖不同地区和竞争域。

逐步指南

- 将data/clean/serp_results_clean.csv和data/clean/queries_clustered.csv加载到pandas(脚本scripts/analyze_regions.py)。

- 通过query列合并,使每个结果拥有集群和意图。

- 添加计算域名位置的功能:为每个城市+请求组合创建排名。位置已经存在于位置列中,请确保其准确性。

- 计算按集群的域名份额:按城市、集群、root_domain分组,平均位置指标和顶级10的份额。

- 添加顶级10标志:位置≤10。计算每个集群和意图中域名在前10中的覆盖率。

- 保存中间表到data/clean/analytics_*.csv: 例如,coverage_by_city_domain.csv、top10_share_by_intent.csv。

建议: 在报告中使用热力图展示覆盖率:城市横向,域名纵向,颜色表示前10请求的份额。这将揭示各地区的强参与者。

✅ 检查: 表格创建无错误,且内容清晰:当地参与者在自己城市的前10份额较高,国家参与者在多个城市的份额相对稳定。

问题与解决方案:如果数据中在前50名的命中率较低,请检查抓取和筛选的准确性。扩大请求列表或增加结果数量到100,如果这在安全范围内。

步骤9:分析地区结果差异和请求本地化情况

阶段目的

确定哪些请求是本地化的,哪些不是,以及这在不同城市的SEO策略中会产生怎样的影响。识别具有强本地性的集群和域名。

逐步指南

- 为每个请求收集按城市排序的前10名域名集合。计算城市之间的交集(例如,莫斯科vs圣彼得堡)。指标:Jaccard = |交集| / |并集|。

- 构建所有城市对的Jaccard汇总表。低值表明结果的地区依赖性强。

- 确定本地化请求:平均Jaccard在所有城市对中的值低于某个阈值(例如0.3)。对于非本地化请求,阈值则高于(例如0.6)。

- 比较意图:通常商业请求的本地化率会高于信息请求。根据每个意图的Jaccard的平均值进行验证。

- 识别“唯一”竞争对手:在某个城市的前10中仅出现一次的域名。为本地链接和合作伙伴关系准备列表。

- 准备报告:1)本地化请求的前10列表,2)非本地化请求的前10列表,3)城市的唯一域名,4)在多个城市中表现稳定的域名。

- 将报告保存到reports/regional_differences.csv,并撰写带有建议的文字总结。

建议: 为域名添加“排名稳定性”的指标:城市中位置的平均值和标准差。帮助您了解哪个城市的域名表现较强。

✅ 检查: 报告中清晰显示某些请求在城市之间明显不同,而其他请求几乎没有变化。您可以列出至少5个本地化和5个非本地化请求。

问题与解决方案:如果差异较小,主题可能与地区无关或样本太窄。添加本地意图的请求(“附近”、“今天送货”、“在我所在城市”)并重复分析。

结果检查

检查清单:1)您拥有10多个城市的有效移动代理,确认地理位置。2)抓取器为每个城市和请求收集了前50名,CSV文件不为空。3)清理和规范化已完成,域名已提取。4)意图的聚类已完成,每个请求都有对应的意图。5)各城市之间的差异报告已生成。6)报告中有本地化和非本地化请求的列表。7)基于数据的本地SEO建议已制定。

如何测试:1)通过相应代理手动比较多个请求。2)与实际结果核对5-10行CSV。3)核实城市的前10确实在您预期的地方有所不同。

成功执行的指标:数据覆盖率不低于计划中城市×请求组合数量的80%;网络错误数量最少;报告清晰、可重复。

常见错误及解决方案

- 问题:验证码和阻止。原因:请求频率高、标题一致、缺乏暂停。解决方案:提高延迟,减少并行度,降低IP轮换频率,更换用户代理,并考虑使用官方API。

- 问题:地理位置不准确。原因:不稳定的代理或缓存。解决方案:通过Yandex.Internetometer检查地理位置,更换IP,选择其他运营商或城市。

- 问题:数据中存在垃圾和重复项。原因:未清理的URL、广告块。解决方案:对域名添加过滤器,规范URL,仅保留有机结果。

- 问题:HTML选择器不稳定。原因:SERP结构变化。解决方案:使用更通用的模式,针对2-3个请求检查抓取器,更新选择器。

- 问题:集群过于狭窄。原因:相似度阈值过高。解决方案:降低阈值,手动合并相近的集群,检查标记。

- 问题:区域差异弱。原因:请求选择不当。解决方案:添加本地化意图并检查各城市对的Jaccard值。

- 问题:代理负载过重。原因:请求数量太多。解决方案:分散时间、使用额外的代理、增加队列和暂停。

附加功能

高级设置:1)根据键(engine, city, query)缓存HTML响应以节省请求。2)在SQLite或PostgreSQL中存储数据,并按city、query、domain建立索引。3)将错误日志记录到单独的日志文件中,并带有时间戳。4)为问题请求添加无头浏览器(例如,使用Selenium),以便在需要JavaScript的情况下获取摘要。5)使用官方API:Google Custom Search API,Yandex.API(如果可用相关端点)。这将降低风险并提高稳定性。

优化:1)延迟和用户代理随机化。2)智能重试:仅重试失败的请求。3)将“重”的请求分配到单独的队列,并稍后处理。4)每周或每月启动监控动态。

还能做些什么:1)计算城市间的Rank-Biased Overlap以更精细地评估结果相似性。2)自动生成建议:为特定城市创建哪些页面更有用。3)使用俄语形态分析器以改善聚类效果。4)准备仪表板(例如,在Power BI中)以可视化各城市的域名和意图覆盖。

建议: 包含一个“黑名单”域名的排除列表,始终从分析中排除(例如,非目标服务),但保留原始数据的副本以便在需要时恢复。

常见问题解答(FAQ)

问题1: 能否不使用移动代理?答案:可以,如果有带地区参数的官方API或使用城市数据中心。但移动代理通常更好地反映真实的本地结果。

问题2: 如何减少验证码概率?答案:增加延迟,降低并行度,轮换用户代理,间歇性地使用IP轮换,并尽可能使用官方API。

问题3: 如何判断请求是否本地化?答案:如果前10名域名的组成在城市间显著变化(低Jaccard值),并且结果中本地目录和地图频繁出现,则请求是本地化的。

问题4: 如果Google和Yandex的HTML结构变化怎么办?答案:保持抓取器模块化,为2-3个标准请求添加自测。当结构变化时,仅更新抓取模块。

问题5: 如何正确标注意图?答案:将自动启发式(提示词列表)与手动检查争议案例结合。根据转化数据细化意图。

问题6: 如果城市数据很少怎么办?答案:扩大请求列表,添加LSI词汇和长尾关键词,选择不同时间段进行抓取,使用替代语义源。

问题7: 如何处理聚合器和市场?答案:不要完全删除它们。将其标记为单个类型并分析其对您领域的影响。这些是流量竞争者。

问题8: 能否将Google和Yandex的数据结合?答案:可以。在报告中保留引擎标签。分别比较它们,以查看跨搜索的域名稳定性。

问题9: 数据更新频率是多少?答案:对于动态领域每2-4周更新一次,对于稳定领域每1-2个月更新一次。保存报告版本以追踪动态。

问题10: 哪些指标最有用?答案:按域名和集群的前10份额、平均位置、排名稳定性、城市间Jaccard值、意图覆盖。

结论

总结您所完成的工作:您为不同城市准备了代理,确认了地理位置,设置了Python环境,抓取了针对所选请求和地区的Google和Yandex前50个结果,清理和规范化了数据,按意图聚类了语义,分析了城市之间结果的不同。最终,您拥有一个实用的报告,显示竞争对手在哪些请求上在每个地区表现强劲,以及哪些请求是本地化的。

后续行动:1)创建并优化针对具有商业意图的本地化集群的着陆页。2)在排名不稳定的城市中加强E-E-A-T信号。3)设置定期数据收集和变更监测。4)根据特定城市的需求调整内容。

未来发展方向:1)与CRM集成以评估各地区的转化率。2)增加行为信号与本地链接。3)扩大城市范围和请求主题。4)实现报告自动化并在BI工具中进行可视化。

建议: 记录每个步骤并保留配置。这样,您的流程可以轻松扩展到新的城市和领域。

建议: 保留报告模板和启动检查清单。这将节省30-40%的重复迭代时间。