TOP-6 najlepszych platform no-code do web scrapingu w chmurze w 2026: pełny przegląd i porównanie

Spis treści

- Wprowadzenie

- Metodologia tworzenia rankingu

- Kryteria wyboru i porównania

- №1. apify — najlepszy balans mocy, odporności na antyboty i skalowalności

- №2. octoparse — najbardziej zrozumiały wizualny kreator dla początkujących

- №3. browse ai — najszybszy start i wygodne integracje z arkuszami

- №4. phantombuster — najlepszy do mediów społecznościowych i generowania leadów

- №5. diffbot — najlepszy do zorganizowanych bytów i semantycznego wyszukiwania

- №6. parsehub — sprawdzony wizualny parser dla podstawowych i średnich zadań

- Tabela porównawcza

- Alternatywy, które nie znalazły się w top

- Rekomendacje dotyczące wyboru

- Faq

- Podsumowanie

Wprowadzenie

Web scraping bez kodu przeżywa nową falę rozwoju: marketerzy, analitycy i przedsiębiorcy potrzebują szybkich, niezawodnych i zgodnych z prawem sposobów na pozyskiwanie danych bez wsparcia zespołu programistów. W latach 2024–2026 narzędzia no-code osiągnęły poziom, w którym można uruchamiać skomplikowane scenariusze zbierania danych z platform sprzedażowych, SERP i mediów społecznościowych w jednym kliknięciu, a wyniki — od razu wysyłać do Google Sheets, CRM lub BI.

Dla kogo to szczególnie ważne? Dla tych, którzy regularnie monitorują ceny i dostępność na platformach (Wildberries, Ozon, Amazon), analizują wyniki wyszukiwania i konkurencję, gromadzą dane z mediów społecznościowych na potrzeby generowania leadów i analizy popytu, aktualizują katalogi i karty produktów. Usługi no-code pozwalają szybko weryfikować hipotezy, nie odciągając zespołu programistycznego od kluczowych zadań.

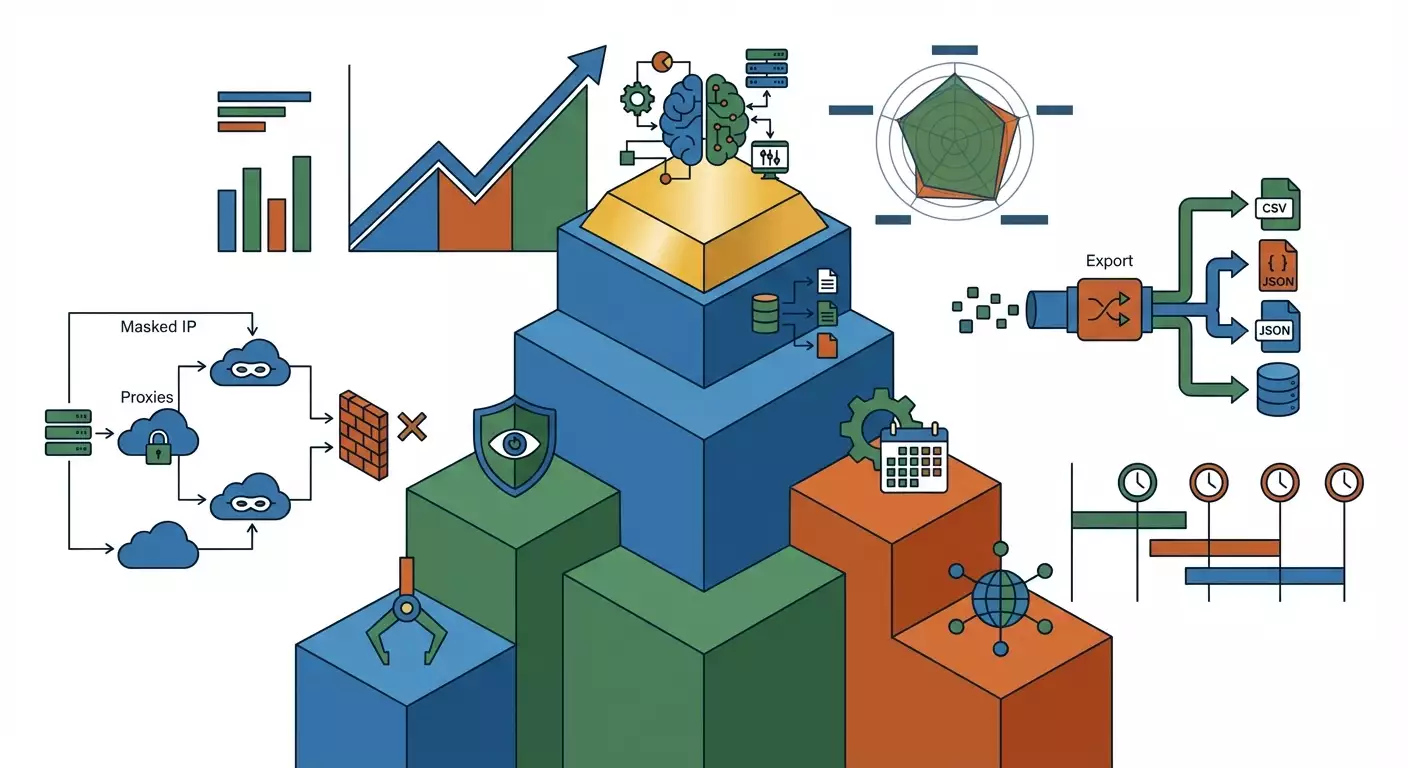

W tym rankingu porównaliśmy sześć najlepszych chmurowych platform no-code do web scrapingu: Apify, Octoparse, ParseHub, PhantomBuster, Diffbot i Browse AI. Ocenialiśmy je pod kątem prostoty użytkowania, wsparcia dla proxy i obiegu antybotów, typów danych do wyodrębnienia, eksportu, ceny, limitów, prędkości i planowania. Na podstawie kryteriów faworytami zostały: Apify — za skalowalność i dojrzałą infrastrukturę, Octoparse — za maksymalnie zrozumiały wizualny kreator, Browse AI — za szybki start i integracje, PhantomBuster — za najlepszą współpracę z mediami społecznościowymi, Diffbot — za gotowe zorganizowane byty i semantyczne wyszukiwanie, ParseHub — jako solidne narzędzie podstawowe z długą historią.

Aktualność cen i charakterystyk potwierdzono na styczeń 2026 roku (niektóre taryfy mogły się zmienić, sprawdzaj informacje w swoich kontach). Kładziemy nacisk na obiektywność i użyteczność dla podejmowania decyzji; każdy serwis ma swoje mocne strony i ograniczenia, a my pokażemy, który z nich będzie dla kogo najlepszy.

Metodologia tworzenia rankingu

Aby uczynić ranking przejrzystym i powtarzalnym, zastosowaliśmy mieszane podejście: funkcjonalne testowanie typowych zadań, przestudiowanie dokumentacji i publicznych stron z taryfami, analizę opinii użytkowników i przypadków, porównanie możliwości integracji i skalowania.

Kryteria i wagi: 1) Funkcjonalność i odporność na antyboty — 30% (obecność wizualnego kreatora, wsparcie dla renderowania JS, obsługa paginacji i dynamicznych stron, omijanie captcha poprzez integracje, odporność na Cloudflare i inne zabezpieczenia). 2) Proxy i możliwości sieciowe — 15% (wbudowana rotacja, proxy datacenter, domowe/mobilne, BYO-proxy). 3) Prostota i UX — 15% (próg wejścia, materiały szkoleniowe, szablony, wstępnie zdefiniowane boty). 4) Cena i limity — 15% (koszt planów i przejrzystość limitów dotyczących zapytań/minut/kredytów). 5) Prędkość i planowanie — 10% (paralelizm, harmonogramy, kolejki). 6) Eksport i integracje — 10% (CSV, JSON, Google Sheets, API, webhooki, Zapier/Make). 7) Wsparcie i opinie — 5% (kanały wsparcia, baza wiedzy, tonacja opinii). Wynik końcowy — ważona średnia dla wszystkich punktów.

Jak zbierano informacje: przeszliśmy onboarding, stworzyliśmy typowe scenariusze (parsowanie kart produktów i cen, monitorowanie SERP, zbieranie publicznych profili i postów), sprawdziliśmy eksport do CSV/JSON i Google Sheets, przetestowaliśmy podstawowe scenariusze antybotów, przestudiowaliśmy oficjalną dokumentację i FAQ, a także typowe limity i warunki użytkowania. Co nie było brane pod uwagę: zamknięte bety i funkcje niedostępne w standardowych planach; indywidualne zniżki; niepubliczne warunki partnerskie; a także scenariusze wykraczające poza etyczne i legalne wykorzystanie danych. Ważne: przestrzegaj warunków użytkowania źródłowych stron, robots.txt i lokalnych przepisów prawnych.

Kryteria wyboru i porównania

Rozłożyliśmy wybór na kluczowe parametry, z którymi zmaga się każdy praktyk.

Łatwość użycia: obecność wizualnego kreatora, szablonów dla popularnych stron, samouczków, poradnika i wideo. Mierzyliśmy według czasu do uzyskania pierwszych wyników i liczby kroków, a także według dostępności typowych szablonów (Amazon, Google SERP, LinkedIn).

Proxy: wbudowana rotacja, obszarowe i domowe IP, możliwość podłączenia mobilnych proxy, wsparcie dla zewnętrznych dostawców. Mierzyliśmy według dostępnych opcji i elastyczności konfiguracji.

Omijanie zabezpieczeń antybotowych: praca przez prawdziwą przeglądarkę z renderowaniem JS, opóźnienia behawioralne, emulacja, wsparcie dla rozwiązywaczy CAPTCHA, odporność na Cloudflare i analogiczne. Mierzyliśmy według stabilności wykonywania zadań na zabezpieczonych stronach i liczby powtórnych prób.

Typy danych: HTML, treści dynamiczne, API i punkty końcowe, wyodrębnianie zorganizowanych bytów (produkt, wiadomość, firma), obrazy. Ważne dla uniwersalności i jakości.

Eksport: wsparcie dla CSV/JSON, arkuszy (Google Sheets), webhooków, REST API, Zapier/Make; mierzyliśmy liczbę dostępnych metod i łatwość konfiguracji.

Cena i limity: koszt podstawowych i zaawansowanych planów, zrozumiałość modelu (kredyty, minuty, zadania), limity dla równoległych zadań oraz dostępność planu darmowego/trialowego.

Prędkość i planowanie: równoległość, kolejki, harmonogram z elastycznymi zasadami (codziennie, wg crona, co X minut), możliwość ponownego uruchomienia w razie błędów.

Szczegółowe wartości graniczne do TOP: praca w chmurze, dostępność scenariuszy lub szablonów no-code, eksport do CSV/JSON i Google Sheets lub przez API, harmonogramy. Wszystkie wybrane sześć platform spełniają te wymagania.

№1. Apify — najlepszy balans mocy, odporności na antyboty i skalowalności

Ogólne informacje

Apify — chmurowa platforma automatyzacji webu i scrapingu z ogromnym sklepem gotowych scraperów (Actors) i infrastrukturą: kolejki, magazyny, proxy, planner, webhooki. Założona w 2015 roku, z siedzibą w UE. Specjalizacja: rozbudowane projekty scrapingu, szablony zorientowane na intencje (Amazon, SERP, sklepy, media społecznościowe), a także ekosystem dla zespołów i integracji z BI. Grupa docelowa: od marketerów i analityków, którym zależy na gotowych presetach i szybkim starcie, po zaawansowanych użytkowników i działy danych, które wymagają elastyczności i niezawodnych proxy.

Kluczowe możliwości

- Duży rynek gotowych „Actors” dla popularnych źródeł (Amazon, Google, LinkedIn, katalogi firm, opinie, wiadomości).

- Wbudowane proxy Apify (proxy datacenter, domowe, SERP), elastyczna rotacja, wsparcie dla zewnętrznych proxy.

- Uruchamianie w prawdziwej przeglądarce, renderowanie JS, zarządzanie sesjami, opóźnieniami, ponownymi próbami; integracja z rozwiązywaczami CAPTCHA przez aktorów.

- Magazyny danych i plików, kolejki zadań, logowanie, monitorowanie i powiadomienia.

- Eksport do CSV/JSON, Google Sheets, API, webhooki; konektory do Zapier/Make.

- Harmonogram z elastycznymi grafikami i wyzwalaczami.

Unikalne cechy: potężny ekosystem Actors, w tym komercyjne i bezpłatne; scrapery SERP i Amazon z obsługą rotacji i geotargetowania; podgląd i testowanie uruchamiania; „data residency” w UE; obszerna dokumentacja i społeczność.

Parametry techniczne: wysoka równoległość, konfigurowalne limity dotyczące pamięci/czasu na zadanie, odporność dzięki ponownym próbom i kolejkom; wsparcie dla funkcji enterprise (SSO, dziennik audytu, model dostępu).

Integracje: API, webhooki, Google Sheets, Zapier/Make, BigQuery/Databricks przez konektory/skrypty (dla no-code wystarczą webhooki lub gotowe integracje).

Cenniki i ceny

Model oparty jest na kredytach platformy i limitach wykonania. Na styczeń 2026: plan Free z niewielką miesięczną kwotą kredytu na testy; plan Starter około 49 USD/miesiąc, plan Team około 499 USD/miesiąc, plan Business — na zapytanie. Płatne proxy (szczególnie domowe) są dodatkowo płatne, a koszt zależy od rodzaju IP i objętości ruchu. Bezpłatny okres próbny i bezpłatne akty są dostępne do sprawdzenia hipotez. Stosunek ceny do jakości jest wysoki z powodu skalowalności i szablonów sklepów: płacisz za rzeczywistą moc i odporność na blokady.

Zalety

- Najsilniejszy ekosystem gotowych scraperów — oszczędza tygodnie programowania.

- Doświadczenie proxy i rotacji, odporność na antyboty, elastyczna konfiguracja.

- Pełny stos: kolejki, magazyny, harmonogramowanie, logowanie, powiadomienia.

- Elastyczny eksport: API, webhooki, CSV/JSON, Google Sheets.

- Poziom profesjonalny dla zespołów i firm: role, SSO, dziennik audytu, SLA.

Wady

- Część Actors jest płatna lub z limitami, trzeba będzie optymalizować budżet.

- Dla bardzo specyficznych stron może być wymagana konfiguracja skomplikowanych parametrów.

- Krzywa uczenia się jest wyższa niż u „najprostszych” kreatorów.

Dla kogo?

Marketerzy i analitycy, którzy potrzebują niezawodnego zbierania danych z platform sprzedażowych i SERP z niskim odsetkiem niepowodzeń; zespoły wzrostu i działy danych uruchamiające dziesiątki zadań według harmonogramu; firmy o wysokich wymaganiach dotyczących bezpieczeństwa i skalowalności.

Ocena według kryteriów

- Funkcjonalność: 9.5/10

- Cena: 8/10

- Łatwość użycia: 8.5/10

- Wsparcie: 8.5/10

- Opinie: 8.5/10

- Ocena ogólna: 9/10

⭐ OCENA OGÓLNA: 9.0/10

- Funkcjonalność: 9.5/10

- Cena: 8/10

- Łatwość użycia: 8.5/10

- Wsparcie: 8.5/10

- Opinie użytkowników: 8.5/10

✅ Najlepszy wybór dla: firm, które potrzebują skalowalności, odporności na blokady i automatyzacji całego procesu od zbierania do exportu.

Główna zaleta: połączenie potężnej infrastruktury i bogatego sklepu gotowych scraperów.

№2. Octoparse — najbardziej zrozumiały wizualny kreator dla początkujących

Ogólne informacje

Octoparse — popularna platforma chmurowa i desktopowa do wizualnego parsowania stron bez kodu. Firma pochodzi z Chin, aktywnie działa na rynku globalnym od połowy lat 2010. Specjalizacja: przejrzysty interfejs, szablony dla powszechnych scenariuszy, prosta konfiguracja działań (kliknięcia, paginacja, przewijanie, wprowadzenie). Grupa docelowa: marketerzy, specjaliści ds. treści, właściciele małych i średnich firm, którym zależy na szybkim starcie i minimalnej krzywej uczenia się.

Kluczowe możliwości

- Wizualny kreator: wybór elementów point-and-click, automatyczne generowanie selektorów XPath/CSS.

- Cloud Extraction: chmurowe agenty wykonują zadania bez lokalnej maszyny.

- Wbudowana rotacja IP, podstawowe ustawienia antybotowe, naśladowanie użytkownika (opóźnienia, przewijanie).

- Renderowanie JS przez wbudowaną przeglądarkę, obsługa stron dynamicznych.

- Eksport do CSV/JSON, Excel, Google Sheets; API; integracje przez Zapier/Make.

- Harmonogramy: codzienne/na godziny/na interwały.

Unikalne cechy: „Smart Mode” do szybkiej automatyzacji tabel z prostych stron; biblioteka szablonów dla popularnych stron; bogate przewodniki i wideo.

Parametry techniczne: stabilny chmurowy runner, równoległe zadania na płatnych taryfach, wsparcie dla autoryzacji i prostych scenariuszy captcha (przez podpowiedzi i zewnętrznych rozwiązujących).

Integracje: Google Sheets, Excel, API, Zapier/Make, bazy danych przez eksporty/skrypty.

Cenniki i ceny

Na styczeń 2026 roku typowa matryca: Free z ograniczeniami szybkości/objętości; Standard około 75 USD/miesiąc; Professional około 209 USD/miesiąc; Enterprise — na zapytanie. Chmurowe minuty i równoległość wzrastają z taryfą. Wbudowane proxy są zawarte w chmurowych uruchomieniach; przy zadaniach lokalnych można łączyć zewnętrzne proxy. Stosunek ceny do jakości jest doskonały dla początkujących i zespołów bez wsparcia inżynieryjnego.

Zalety

- Najlepszy wizualny kreator do szybkiego startu.

- Szablony i materiały edukacyjne znacznie skracają czas konfiguracji.

- Chmurowe agenty i wbudowana rotacja IP ułatwiają eksploatację.

- Elastyczny eksport i automatyzacja przez API i Zapier/Make.

- Dobry dla masowych zadań na prostych i średnio skomplikowanych stronach.

Wady

- Skomplikowane strony antybotowe (silny Cloudflare, trudne captcha) mogą wymagać obejść i i tak upadać.

- Głęboko zakorzenione scenariusze czasami ograniczają się do wizualnego przepływu.

- Optymalizacja dużego strumienia zadań wymaga starannej konfiguracji harmonogramów i limitów.

Dla kogo?

Początkujący, SMB, marketerzy z ograniczonym czasem na konfigurację; projekty z regularnymi, ale nie ekstremalnymi objętościami danych; scrapowanie katalogów, wiadomości, kart produktów średnich stron, gdzie najważniejsza jest szybkość wdrożenia.

Ocena według kryteriów

- Funkcjonalność: 8.5/10

- Cena: 8/10

- Łatwość użycia: 9/10

- Wsparcie: 8/10

- Opinie: 8.3/10

- Ocena ogólna: 8.5/10

⭐ OCENA OGÓLNA: 8.5/10

- Funkcjonalność: 8.5/10

- Cena: 8/10

- Łatwość użycia: 9/10

- Wsparcie: 8/10

- Opinie użytkowników: 8.3/10

✅ Najlepszy wybór dla: początkujących i zespołów bez programistów, którzy potrzebują szybkich wyników no-code.

Główna zaleta: intuicyjny wizualny kreator i biblioteka szablonów.

№3. Browse AI — najszybszy start i wygodne integracje z arkuszami

Ogólne informacje

Browse AI — chmurowe narzędzie, w którym „uczysz” robota rejestrować działania i wybierać dane na stronie, a następnie uruchamiasz monitoring i eksport do integracji. Firma koncentruje się na prostocie, szybkości i typowych przypadkach biznesowych: monitoring cen, śledzenie kart produktów, SERP, arkusze leadów. Grupa docelowa: marketerzy, analitycy produktów, właściciele e-commerce i agencje.

Kluczowe możliwości

- Training-by-recording: uczenie robota na przykładzie w kilku kliknięciach.

- Chmurowe przeglądarki, podstawowa rotacja IP; roboty mogą działać zgodnie z harmonogramem.

- Gotowe przepisy dla popularnych stron i zadań.

- Eksport do Google Sheets „z pudełka”, CSV/JSON przez API i webhooki.

- Powiadomienia i alerty przy zmianach danych.

Unikalne cechy: maksymalna prostota uruchamiania zadań dla nietechnicznej publiczności; bardzo szybka integracja z Google Sheets; wygodne zarządzanie robotami i ich statusami.

Parametry techniczne: chmurowa kolejka i równoległość są ograniczone taryfą; wspierane są autoryzacje, przebieg kliknięć, klikanie paginacji; podstawowe sugestie antybotowe. Dla skomplikowanych stron może być wymagana delikatna konfiguracja opóźnień, szablonów i alternatywnych ścieżek.

Integracje: Google Sheets, powiadomienia Slack/Email, API i webhooki, Zapier/Make dla połączeń z CRM/BI.

Cenniki i ceny

Typowa matryca na styczeń 2026: Free z ograniczeniami (kilka robotów, niewielkie limity); Starter około 48 USD/miesiąc; Professional około 124 USD/miesiąc; Team około 249 USD/miesiąc; Enterprise — na zapytanie. Weź pod uwagę koncepcję „kredytów” lub „uruchomień” robotów i limitów monitorowania; finalna cena zależy od częstotliwości aktualizacji i liczby stron. Stosunek ceny do jakości jest bardzo dobry dla zadań z częstotliwością 1–4 razy dziennie i umiarkowanymi objętościami.

Zalety

- Super szybki start: uruchomienie treningu robota zajmuje minuty.

- Idealne połączenie z Google Sheets i powiadomieniami.

- Odpowiednie dla płatnych SMB i działów marketingowych.

- Proste przepisy pod typowe zadania (SERP, karty produktów, monitoring cen).

- Automatyczne powtórzenia i alerty przy awariach.

Wady

- Ograniczona odporność na skomplikowane systemy antybotowe.

- Mniej elastyczny dla bardzo zindywidualizowanych scenariuszy niż platformy na poziomie Apify.

- Wraz ze wzrostem częstotliwości monitorowania i stron końcowa cena może znacznie wzrosnąć.

Dla kogo?

Marketerzy, analitycy, menedżerowie produktów, właściciele małych i średnich firm e-commerce; zadania, gdzie potrzebny jest szybki start, prostota wsparcia i jasny eksport do Sheets/API.

Ocena według kryteriów

- Funkcjonalność: 8/10

- Cena: 8.5/10

- Łatwość użycia: 9.2/10

- Wsparcie: 7.8/10

- Opinie: 8.5/10

- Ocena ogólna: 8.4/10

⭐ OCENA OGÓLNA: 8.4/10

- Funkcjonalność: 8/10

- Cena: 8.5/10

- Łatwość użycia: 9.2/10

- Wsparcie: 7.8/10

- Opinie użytkowników: 8.5/10

✅ Najlepszy wybór dla: szybkiego uruchamiania monitorowania stron i SERP z eksportem do Sheets.

Główna zaleta: minimalny próg wejścia i wygodne integracje.

№4. PhantomBuster — najlepszy do mediów społecznościowych i generowania leadów

Ogólne informacje

PhantomBuster — chmurowa platforma automatyzacji i scrapingu z naciskiem na media społecznościowe i lejki sprzedażowe. Oferuje „phantomy” — gotowe boty do LinkedIn, X, Instagrama, Facebooka, Google i innych. Założona pod koniec lat 2010, nastawiona na rynki globalne. Grupa docelowa: zespoły SDR/BDR, marketerzy performance, agencje, które potrzebują zbierać i wzbogacać leady z mediów społecznościowych, uruchamiać outreach i automatyzować rutynowe działania.

Kluczowe możliwości

- Duża biblioteka phantomów dla mediów społecznościowych i Google: parsowanie profili, postów, komentatorów, subskrybentów; masowe wysyłki i automatyzacje w ramach dozwolonych działań.

- Chmurowe przeglądarki, podstawowa rotacja IP; wsparcie dla podłączenia własnych proxy.

- Planowanie i łańcuchy działań; zapisywanie sesji dla kont.

- Eksport do CSV/JSON, Google Sheets; API i webhooki.

- Powiadomienia i rekomendacje dotyczące anty-ban (ograniczenia i limity platform).

Unikalne cechy: silna specjalizacja pod LinkedIn i inne media społecznościowe; kombinacja scrapingu i automatyzacji outreach; typowe pipeline'y dla generowania leadów.

Parametry techniczne: ograniczenia dotyczące „slotów” i minut realizacji w zależności od taryfy; wspierana imitacja behawioralna; odporność na banowanie zależy od higieny konta i scenariuszy.

Integracje: Google Sheets, CRM przez Zapier/Make i API; powiadomienia.

Cenniki i ceny

Na styczeń 2026: Starter około 69 USD/miesiąc, Pro około 139 USD/miesiąc, Team około 399 USD/miesiąc, Enterprise — na zapytanie. Plan określa liczbę phantomów, dzienne limity działania i równoległość. Wbudowana rotacja IP jest obecna, ale dla skomplikowanych przypadków w mediach społecznościowych zaleca się korzystanie z BYO-proxy i precyzyjne ustawienie częstotliwości działań. Dobre proporcje ceny do efektów w swojej niszy.

Zalety

- Najlepsza specjalizacja dla mediów społecznościowych i generowania leadów.

- Gotowe phantomy do kluczowych zadań LinkedIn/X/Instagrama.

- Dobra integracja z arkuszami i CRM przez Zapier/Make.

- Proste łańcuchy działań i planowanie kampanii.

- Wsparcie dla zewnętrznych proxy dla elastyczności i odporności.

Wady

- Wąska specjalizacja: jako uniwersalny web scraper ustępuje Apify i Octoparse.

- Ryzyko blokad w mediach społecznościowych przy agresywnych scenariuszach.

- Struktura limitów (sloty/minuty) wymaga przyzwyczajenia.

Dla kogo?

Zespoły sprzedażowe, agencje marketingowe, specjaliści ds. outreach i SMM, którzy potrzebują przepływów leadów z mediów społecznościowych i automatyzacji działań w ramach zasad platform.

Ocena według kryteriów

- Funkcjonalność: 8/10

- Cena: 7.5/10

- Łatwość użycia: 8.7/10

- Wsparcie: 8/10

- Opinie: 8.2/10

- Ocena ogólna: 8.1/10

⭐ OCENA OGÓLNA: 8.1/10

- Funkcjonalność: 8/10

- Cena: 7.5/10

- Łatwość użycia: 8.7/10

- Wsparcie: 8/10

- Opinie użytkowników: 8.2/10

✅ Najlepszy wybór dla: generowania leadów z mediów społecznościowych i outreach.

Główna zaleta: maksymalna gotowość do mediów społecznościowych i typowych procesów sprzedażowych.

№5. Diffbot — najlepszy do zorganizowanych bytów i semantycznego wyszukiwania

Ogólne informacje

Diffbot — platforma AI do wyodrębniania z gotowymi modelami bytów (Article, Product, Organization itd.) oraz własnym Knowledge Graph. Uruchomiona na początku lat 2010 w USA. Specjalizacja: automatyczne wyodrębnianie zorganizowanych danych z stron internetowych bez konfiguracji selektorów, pełnotekstowe i semantyczne wyszukiwanie w grafie wiedzy. Grupa docelowa: badacze rynku, analityka korporacyjna, fintech i duże przedsiębiorstwa, dla których ważna jest precyzja bytów i dostęp do grafu.

Kluczowe możliwości

- Model-based extraction: gotowe modele dla wiadomości, produktów, firm itd.

- Knowledge Graph: dostęp do ogromnego grafu danych webowych przez API.

- Crawlbot i automatyczne wyodrębnienie, przestrzegające robots domyślnie.

- JSON-odpowiedzi z strukturą bytów; integracja przez API.

- Możliwość precyzyjnych reguł i personalizacji pod domeny.

Unikalne cechy: otrzymujesz zorganizowane dane bez ręcznej nauki selektorów; skala pod postacią Knowledge Graph; potężne wyszukiwanie i agregacja po bytach.

Parametry techniczne: chmurowa infrastruktura, wysoka odporność na zmiany w układzie stron dzięki ML; nie jest nastawiona na omijanie antybotów „za wszelką cenę” — akcent na legalne zbieranie i jakość wyodrębnianych bytów.

Integracje: API, konektory przez narzędzia ETL, eksport danych do magazynów przez pipeline'y.

Cenniki i ceny

Pozycjonowane jako rozwiązanie na poziomie „premium”. Na styczeń 2026 orientacyjnie: Starter w okolicy 299 USD/miesiąc, Plus/Enterprise — znacząco drożej. Cena zależy od objętości zapytań, dostępu do KG i zestawu funkcji. Dla SMB budżet może być odczuwalny; dla korporacji — odpowiada wartości danych. Zazwyczaj brak jest planów darmowych, ale dostępne są demo/triale.

Zalety

- Gotowe byty: oszczędność czasu na konfiguracjach i odporność na zmiany HTML.

- Knowledge Graph: dostęp do unikalnych danych i powiązań.

- Wysoka jakość struktury, użyteczne dla analityki i badań.

- Podejście API-first, łatwa integracja w korporacyjnych pipeline'ach.

- Minimalne ręczne wsparcie w porównaniu do parserów selektorowych.

Wady

- Wysoka cena dla startupów i SMB.

- Ograniczona elastyczność dla niestandardowych stron i „ciężkiego” antybota.

- Orientacja na API/ML — dla no-code potrzebna jest warstwa integracji.

Dla kogo?

Średnie i duże przedsiębiorstwa, zespoły analityczne i badawcze, dla których ważne są gotowe byty i dostęp do grafu wiedzy, a nie rozwijanie własnych parserów.

Ocena według kryteriów

- Funkcjonalność: 8.7/10

- Cena: 6/10

- Łatwość użycia: 7.5/10

- Wsparcie: 8/10

- Opinie: 8/10

- Ocena ogólna: 7.7/10

⭐ OCENA OGÓLNA: 7.7/10

- Funkcjonalność: 8.7/10

- Cena: 6/10

- Łatwość użycia: 7.5/10

- Wsparcie: 8/10

- Opinie użytkowników: 8/10

✅ Najlepszy wybór dla: przedsiębiorstw, którym zależy na gotowych zorganizowanych bytach i Knowledge Graph.

Główna zaleta: wysokotrafne ML-wydobycie bez konfiguracji selektorów.

№6. ParseHub — sprawdzony wizualny parser dla podstawowych i średnich zadań

Ogólne informacje

ParseHub — jeden z „weteranów” wizualnego scrapingu, łączący desktopowy kreator z chmurowym uruchamianiem i przechowywaniem wyników. Założony w połowie lat 2010 w Kanadzie. Specjalizacja: zrozumiały podejście do scenariuszy (kliknięcia, paginacja, wyodrębnianie list), umiarkowane wsparcie dla dynamiki. Grupa docelowa: użytkownicy, którym wystarcza podstawowe narzędzie wizualne i regularny eksport bez skomplikowanych scenariuszy antybotowych.

Kluczowe możliwości

- Wizualna analiza elementów, list i paginacji.

- Chmurowe uruchamianie z przechowywaniem wyników.

- Renderowanie JS i obsługa prostych stron SPA.

- Eksport do CSV/JSON, Google Sheets przez integracje/skrypty, API.

- Harmonogramy i monitoring zadań.

Unikalne cechy: prosty i sprawdzony czasowo interfejs; materiały edukacyjne do typowych scenariuszy.

Parametry techniczne: nadaje się dla małych i średnich projektów; silny antybot i skomplikowane zabezpieczenia Cloudflare są słabym punktem; wymaga ostrożnych opóźnień i ponownych prób.

Integracje: API, CSV/JSON, konektory przez Zapier/Make.

Cenniki i ceny

Na styczeń 2026: Free z ograniczeniami; Standard około 189 USD/miesiąc; Professional około 499 USD/miesiąc; Enterprise — na zapytanie. Limity dotyczą liczby projektów, równoległych zadań i szybkości. Stosunek ceny do jakości jest uzasadniony dla konserwatywnych scenariuszy, ale w przypadku skomplikowanych stron może być wymagana inna platforma.

Zalety

- Sprawdzona, wizualna metoda.

- Wystarczająca dla wielu podstawowych zadań.

- Chmurowe uruchomienia, API i eksport do CSV/JSON.

- Dobra dokumentacja i społeczność.

- Odpowiednia dla celów edukacyjnych i pilotów.

Wady

- Skomplikowane strony antybotowe są trudne do przejścia.

- Interfejs i architektura są mniej elastyczne niż liderzy.

- Cena Professional jest zbliżona do bardziej zaawansowanych rozwiązań.

Dla kogo?

Dla początkujących użytkowników, SMB, małych zespołów, które scrapują proste strony, katalogi i strony o minimalnej ochronie i nie wymagają dużej częstotliwości aktualizacji.

Ocena według kryteriów

- Funkcjonalność: 7.5/10

- Cena: 7/10

- Łatwość użycia: 7.8/10

- Wsparcie: 7.5/10

- Opinie: 7.6/10

- Ocena ogólna: 7.5/10

⭐ OCENA OGÓLNA: 7.5/10

- Funkcjonalność: 7.5/10

- Cena: 7/10

- Łatwość użycia: 7.8/10

- Wsparcie: 7.5/10

- Opinie użytkowników: 7.6/10

✅ Najlepszy wybór dla: niewielkich projektów i zadań edukacyjnych.

Główna zaleta: stabilne narzędzie podstawowe do wizualnego scrapingu.

Tabela porównawcza

- Apify: silny antybot i proxy (datacenter/domowe/SERP), sklep Actors, eksport API/webhooki/Sheets, skalowanie i planowanie na poziomie enterprise. Cena: Free, Starter ~ 49 USD, Team ~ 499 USD, Business — indywidualnie. Najlepsze dla platform sprzedażowych i SERP przy dużych objętościach.

- Octoparse: najlepszy wizualny kreator dla początkujących, chmurowe agenty i rotacja IP, eksport do Sheets/API, harmonogramy. Cena: Free, Standard ~ 75 USD, Professional ~ 209 USD. Najlepsze dla szybkiego startu no-code na prostych/średnich stronach.

- Browse AI: uczenie robota rejestracją, szybkie integracje z Sheets, powiadomienia, API/webhooki. Cena: Free, Starter ~ 48 USD, Pro ~ 124 USD, Team ~ 249 USD. Najlepsze dla regularnego monitorowania stron i SERP z niską złożonością antybota.

- PhantomBuster: phantom do mediów społecznościowych i Google, rotacja IP, łańcuchy, Sheets/API. Cena: Starter ~ 69 USD, Pro ~ 139 USD, Team ~ 399 USD. Najlepsze dla generowania leadów w mediach społecznościowych.

- Diffbot: ML-wydobycie bytów, Knowledge Graph, podejście API-first. Cena: od ~ 299 USD/miesiąc. Najlepsze dla analityki i badań, gdzie ważne są gotowe byty.

- ParseHub: podstawowy wizualny parser z chmurowymi uruchomieniami, CSV/JSON/API. Cena: Free, Standard ~ 189 USD, Professional ~ 499 USD. Odpowiedni dla prostych zadań, ale skomplikowany antybot — nie jest jego mocną stroną.

Alternatywy, które nie znalazły się w TOP

Warto również wspomnieć o kilku rozwiązaniach, które są bliskie funkcjonalnością, ale w sumie kryteriów ustąpiły liderom.

- WebScraper.io Cloud: popularne rozszerzenie z chmurową subskrypcją. Świetnie nadaje się do przypadków edukacyjnych i podstawowych zadań, ale odporność na antyboty i skalowanie ustępuje Apify i Octoparse.

- Bright Data Web Scraper: potężna ekosystem proxy i narzędzi, ale dla no-code wymagana jest większa konfiguracja, a cena przy dużych objętościach jest znacząca.

- Zyte (ex-Scrapinghub) + Automatic Extraction: silna platforma i menedżer proxy, ale znacznie bardziej ukierunkowana na zespoły techniczne i dostosowane pipeline'y.

Rekomendacje dotyczące wyboru

- Najlepszy dla początkujących: Octoparse — najbardziej zrozumiały wizualny kreator plus szablony.

- Najlepszy dla profesjonalistów: Apify — skalowalność, proxy, odporność na antyboty, sklep Actors.

- Najlepszy w cenie: Browse AI w małych/średnich ilościach z rzadkimi uruchomieniami i Sheets.

- Najlepszy pod względem funkcjonalności: Apify — pełny stos i głębokość ustawień.

- Najlepszy dla małego biznesu: Browse AI lub Octoparse (szybki start, zrozumiały UX).

- Najlepszy dla średniego biznesu: Octoparse lub Apify (zależnie od złożoności stron i ilości).

- Najlepszy dla dużego biznesu: Apify lub Diffbot (funkcje enterprise, skalowanie, SLA).

Oddzielne scenariusze: dla platform sprzedażowych (Wildberries, Ozon, Amazon) — Apify dzięki Actors i proxy; Octoparse będzie odpowiednia dla prostych witryn i kart produktów bez agresywnej ochrony. Dla SERP — Apify (są gotowe scrapery z geotargetowaniem), Browse AI — dla łatwego monitorowania i Sheets. Dla mediów społecznościowych — PhantomBuster jest zdecydowanym liderem pod kątem gotowości i automatyzacji.

FAQ

Czy można scrapować platformy sprzedażowe bez blokad?

Całkowicie wyeliminować blokady się nie da, ale Apify z domowymi proxy i odpowiednimi opóźnieniami znacznie redukuje ryzyko. Octoparse i Browse AI nadają się do mniej chronionych stron. Przestrzegaj warunków użycia stron i etyki korzystania.

Która platforma jest najlepsza dla Wildberries i Ozon?

Apify — z powodu Actors, elastycznych proxy i odporności. Dla prostych kart — Octoparse. Sprawdzaj aspekty prawne i częstotliwość zapytań.

Co wybrać do monitorowania SERP?

Apify — za gotowe SERP-scrapery i geotargeting; Browse AI — za prostotę i Sheets; PhantomBuster — jeśli potrzebujesz połączyć SERP z późniejszym outreach.

Która system jest najlepszy dla mediów społecznościowych?

PhantomBuster: gotowe phantomy, łańcuchy, eksport do CRM. Apify też może, ale wymaga więcej konfiguracji. Zawsze uwzględniaj zasady platform i używaj bezpiecznych limitów.

Czy potrzebne są własne proxy?

Apify i PhantomBuster wspierają BYO-proxy; Octoparse — dla zadań lokalnych; Browse AI i Diffbot zwykle działają z wbudowaną infrastrukturą. Własne proxy są potrzebne przy skomplikowanych antybotach lub specyficznych geo.

Jak wybrać między Octoparse a ParseHub?

Octoparse jest nowocześniejszy wizualnie i bardziej przyjazny dla początkujących; ParseHub — „klasyka” dla podstawowych scenariuszy. Przy skomplikowanych stronach oba ustąpią Apify.

Jak dokładne są ceny?

Ceny zostały podane na podstawie stanu na styczeń 2026 roku na podstawie publicznych źródeł i typowych ofert; sprawdzaj aktualne warunki w swoim koncie, ponieważ promocje i limity się zmieniają.

Czy są ograniczenia dotyczące częstotliwości uruchomień?

Tak, wszystkie platformy mają limity dotyczące minut/uruchomień/kredytów. Apify i Octoparse elastycznie się skalują; Browse AI i PhantomBuster są ograniczone liczbą robotów/phantomów i częstotliwością. Planuj harmonogramy i rozkładaj obciążenie.

Czy można eksportować bezpośrednio do BI?

Tak: przez API i webhooki, a także konektory do Zapier/Make i pośrednie arkusze. Apify — najelastyczniejszy; Diffbot — API-first; Octoparse i Browse AI — świetnie współpracują z Sheets.

Jak omijać CAPTCHA?

Integruj rozwiązania CAPTCHA lub zmniejszaj częstotliwość i zwiększaj jakość rotacji. Apify oferuje konfigurowalne pipeline'y i integracje; w pozostałych — używaj opóźnień, grafików i „ludzkich” wzorców.

Podsumowanie

Podsumowanie rankingu: Apify — najlepszy pod względem wszystkich parametrów: odporność na antyboty, proxy, ekosystem Actors, skalowanie i integracje. Octoparse — najlepszy dla początkujących i SMB dzięki wizualnemu kreatorowi. Browse AI — najszybsza droga do monitorowania z eksportem do Google Sheets. PhantomBuster — bezsprzeczny lider w zakresie mediów społecznościowych i generowania leadów. Diffbot — optymalny dla dużych zadań analitycznych z gotowymi bytami. ParseHub — niezawodne narzędzie podstawowe dla prostych scenariuszy.

Rekomendacje: dla platform sprzedażowych (Wildberries, Ozon, Amazon) — Apify; dla SERP — Apify lub Browse AI; dla mediów społecznościowych — PhantomBuster; dla głębokich projektów analitycznych i semantyki — Diffbot; dla szybkiego startu no-code — Octoparse; dla zadań edukacyjnych i podstawowych — ParseHub. Pamiętaj o legalności i polityce stron; planuj obciążenie i korzystaj z rotacji proxy.

Trendy 2024–2025 aktualne w 2026: wzrost roli gotowych szablonów i asystentów AI w konfigurowaniu scraperów, konwergencja scrapingu z automatyzacją procesów outreach i pipeline'ów danych, wzmocnienie zabezpieczeń antybotów i skomplikowanie omijania bez wysokiej jakości rotacji IP i emulacji behawioralnej. W najbliższych latach oczekuj większego konfigurowania napędzanego AI, automatycznych sugestii dotyczących odporności i trybów zbierania danych uwzględniających aspekty prawne z wyprzedzeniem.

Artykuł przygotowany w styczniu 2026 roku. Sprawdzaj bieżące taryfy i limity w swoich kontach — dostawcy regularnie aktualizują oferty i warunki.