TOP-6 Mejores Plataformas No-Code para Web Scraping en 2026: Reseña Completa y Comparación

Contenido del artículo

- Introducción

- Metodología para el ranking

- Criterios de selección y comparación

- No. 1. apify — el mejor equilibrio entre potencia, resistencia a anti-bots y escalabilidad

- No. 2. octoparse — el constructor visual más comprensible para principiantes

- No. 3. browse ai — el inicio más rápido y cómodas integraciones con hojas de cálculo

- No. 4. phantombuster — el mejor para redes sociales y generación de leads

- No. 5. diffbot — el mejor para entidades estructuradas y búsqueda semántica

- No. 6. parsehub — parser visual confiable para tareas básicas y medianas

- Tabla comparativa

- Alternativas no incluidas en el top

- Recomendaciones de selección

- Faq

- Conclusión

Introducción

El web scraping sin código está viviendo una nueva etapa de desarrollo: los mercadólogos, analistas y emprendedores necesitan maneras rápidas, fiables y legales de obtener datos sin contar con un equipo de desarrolladores. En 2024–2026, las herramientas no-code han alcanzado un nivel que permite lanzar escenarios complejos de recolección de datos de marketplaces, SERP y redes sociales con un solo clic, y enviar los resultados directamente a Google Sheets, CRM o BI.

¿A quién le importa esto especialmente? A aquellos que monitorean regularmente precios y disponibilidad en marketplaces (Wildberries, Ozon, Amazon), analizan resultados de búsqueda y competidores, agregan datos de redes sociales para generación de leads y análisis de demanda, y actualizan catálogos y fichas de productos. Los servicios no-code permiten validar hipótesis rápidamente, sin distraer al desarrollo de tareas clave.

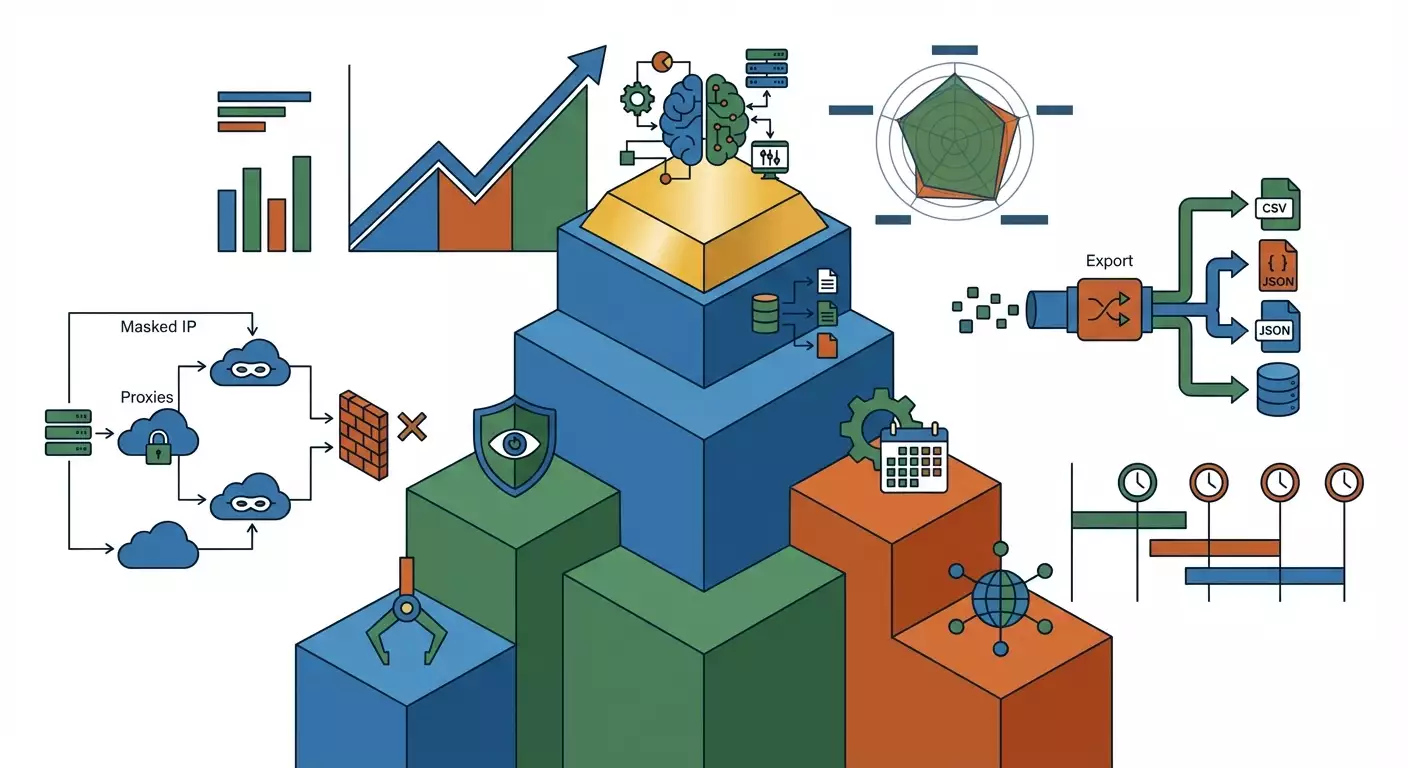

En este ranking, comparamos seis de las mejores plataformas en la nube no-code para web scraping: Apify, Octoparse, ParseHub, PhantomBuster, Diffbot y Browse AI. Las evaluamos en base a su facilidad de uso, soporte de proxies y evasión de protecciones anti-bots, tipos de datos extraídos, exportación, precios, límites, velocidad y programación. Según todos estos criterios, los favoritos son: Apify — por su escalabilidad y madura infraestructura, Octoparse — por su constructor visual entendido, Browse AI — por su inicio rápido e integraciones, PhantomBuster — por su excepcional trabajo con redes sociales, Diffbot — por sus entidades estructuradas listas y búsqueda semántica, ParseHub — como herramienta básica sólida con una larga historia.

La actualidad de precios y características está confirmada a enero de 2026 (algunos planes pueden haber cambiado, verifica la información en tus cuentas). Hicimos hincapié en la objetividad y utilidad para la toma de decisiones; cada servicio tiene sus fortalezas y limitaciones, y mostraremos a quién le conviene más cada uno.

Metodología para el Ranking

Para hacer el ranking transparente y reproducible, utilizamos un enfoque mixto: pruebas funcionales de tareas típicas, revisión de documentación y páginas públicas con tarifas, análisis de reseñas de usuarios y casos, comparación de oportunidades de integración y escalabilidad.

Criterios y pesos: 1) Funcionalidad y resistencia a anti-bots — 30% (existencia de un constructor visual, soporte de renderizado JS, manejo de paginación y páginas dinámicas, bypass de captchas a través de integraciones, resistencia a Cloudflare y otras protecciones). 2) Proxies y capacidades de red — 15% (rotación incorporada, proxies residenciales/móviles, BYO-proxies). 3) Facilidad y UX — 15% (barrera de entrada, materiales de formación, plantillas, bots preconfigurados). 4) Precio y límites — 15% (costo de los planes y transparencia de límites por solicitudes/minutos/créditos). 5) Velocidad y programación — 10% (paralelismo, horarios, colas). 6) Exportación e integraciones — 10% (CSV, JSON, Google Sheets, API, webhooks, Zapier/Make). 7) Soporte y reseñas — 5% (canales de soporte, base de conocimientos, tono de las reseñas). La calificación final es un promedio ponderado de todos los puntos.

Cómo se recopiló la información: pasamos por el onboarding, creamos escenarios típicos (extracción de fichas de productos y precios, monitoreo de SERP, recopilación de perfiles públicos y publicaciones), probamos la exportación a CSV/JSON y Google Sheets, y probamos los escenarios básicos de anti-bots, además de revisar la documentación oficial y las preguntas frecuentes públicas, así como los límites y condiciones de uso. Lo que no se tuvo en cuenta: betas privadas y funciones no disponibles en los planes estándar; descuentos personalizados; condiciones asociadas no públicas; así como escenarios que van más allá del uso ético y legal de los datos. Importante: cumple con las condiciones de uso de los sitios fuente, robots.txt y normas locales de derecho.

Criterios de Selección y Comparación

Desglosamos la selección en parámetros clave con los que se enfrenta cualquier practicante.

Facilidad de uso: disponibilidad de un constructor visual, plantillas para sitios populares, recorridos formativos, manuales y video tutoriales. Medimos el tiempo hasta el primer resultado y el número de pasos, así como la presencia de plantillas típicas (Amazon, Google SERP, LinkedIn).

Proxies: rotación incorporada, disponibilidad de IPs de centros de datos y residenciales, opción de conectar proxies móviles, soporte para proveedores externos. Medimos esto en base a la disponibilidad de opciones y flexibilidad de configuración.

Evasión de protecciones anti-bots: trabajo a través de un navegador real con renderizado JS, retrasos de comportamiento, emulación, soporte para resolutores de captcha, resistencia a Cloudflare y similares. Medimos el rendimiento estable de tareas en sitios protegidos y la cantidad de reintentos.

Tipos de datos: HTML, contenido dinámico, API y endpoints, extracción de entidades estructuradas (producto, noticia, compañía), imágenes. Importante por su versatilidad y calidad.

Exportación: soporte para CSV/JSON, hojas (Google Sheets), webhooks, REST API, Zapier/Make; medimos la cantidad de formas disponibles y la facilidad de configuración.

Precio y límites: costo de los planes básicos y avanzados, claridad del modelo (créditos, minutos, tareas), límites sobre tareas paralelas, así como la existencia de un plan/trial gratuito.

Velocidad y programación: paralelismo, colas, programador con reglas flexibles (diarias, cron, cada X minutos), posibilidad de reinicio tras fallos.

Valuaciones para ser incluido en el TOP: trabajo en la nube, existencia de escenarios o plantillas no-code, exportación a CSV/JSON y Google Sheets o a través de API, programación. Las seis plataformas seleccionadas cumplen con estos requisitos.

No. 1. Apify — el mejor equilibrio entre potencia, resistencia a anti-bots y escalabilidad

Información General

Apify — plataforma en la nube para automatización web y scraping con una enorme tienda de scrapers listos (Actors) e infraestructura: colas, almacenamiento, proxies, programador, webhooks. Fundada en 2015, se basa en la UE. Especialización: grandes proyectos de scraping, plantillas orientadas a la intención (Amazon, SERP, tiendas, redes sociales), así como un ecosistema para equipos e integraciones con BI. Audiencia objetivo: desde mercadólogos y analistas que valoran presets listos y un inicio rápido, hasta usuarios avanzados y departamentos de datos que requieren flexibilidad y proxies fiables.

Características Clave

- Gran marketplace de "Actors" listos para fuentes populares (Amazon, Google, LinkedIn, directorios de empresas, reseñas, noticias).

- Proxy integrado de Apify (centros de datos, residenciales, SERP), rotación flexible, soporte para proxies externos.

- Ejecución en un navegador real, renderizado JS, gestión de sesiones, retrasos, reintentos; integración con resolutores de captcha a través de actores.

- Almacenes de datos y archivos, colas de tareas, registro, monitoreo y alertas.

- Exportación a CSV/JSON, Google Sheets, API, webhooks; conectores a Zapier/Make.

- Programador con horarios flexibles y triggers.

Características únicas: potente ecosistema de Actors, incluyendo diferentes opciones (comerciales y gratuitos); scrapers de SERP y Amazon con soporte de rotación y geotargeting; vista previa y ejecución de prueba; "data residency" en la UE; documentación extensa y comunidad activa.

Especificaciones técnicas: alta paralelidad, límites configurables en memoria/tiempo por tarea, resistencia por medio de reintentos y colas; soporte de características empresariales (SSO, audit log, modelo de acceso basado en roles).

Integraciones: API, webhooks, Google Sheets, Zapier/Make, BigQuery/Databricks a través de conectores/scripts (para no-code, con webhooks o integraciones listas es suficiente).

Tarifas y Precios

Modelo basado en créditos de la plataforma y límites de ejecución. A enero de 2026: plan Free con un pequeño crédito mensual para pruebas; Starter alrededor de $49/mes, Team alrededor de $499/mes, Business — por consulta. Proxies pagados (especialmente residenciales) tienen un costo adicional, el precio depende del tipo de IP y volumen de tráfico. Periodo gratuito y actores gratuitos disponibles para probar hipótesis. Relación precio/calidad alta debido a la escalabilidad y plantillas de tienda: pagas por potencia real y resistencia a bloqueos.

Ventajas

- El ecosistema más fuerte de scrapers listos, ahorrando semanas de desarrollo.

- Proxies maduros y rotación, resistencia a anti-bots, configuración flexible.

- Stack completo: colas, almacenamiento, programador, registro, alertas.

- Exportación flexible: API, webhooks, CSV/JSON, Google Sheets.

- Nivel profesional para equipos y empresas: roles, SSO, audit log, SLA.

Desventajas

- Algunos Actors son de pago o tienen límites, tendrás que optimizar tu presupuesto.

- Para sitios muy específicos puede requerir configuración de parámetros complejos.

- La curva de aprendizaje es más alta que la de los constructores "más simples".

Para Quién es Adecuado

Mercadólogos y analistas que necesitan recolección fiable de marketplaces y SERP con bajo porcentaje de fallos; equipos de crecimiento y departamentos de datos lanzando decenas de tareas programadas; empresas con altos requisitos de seguridad y escalabilidad.

Valoración por Criterios

- Funcionalidad: 9.5/10

- Precio: 8/10

- Usabilidad: 8.5/10

- Soporte: 8.5/10

- Reseñas: 8.5/10

- Valoración General: 9/10

⭐ Valoración General: 9.0/10

- Funcionalidad: 9.5/10

- Precio: 8/10

- Facilidad de Uso: 8.5/10

- Soporte Técnico: 8.5/10

- Reseñas de Usuarios: 8.5/10

✅ Mejor opción para: empresas que necesitan escalabilidad, resistencia a bloqueos y automatización de todo el pipeline desde la recolección hasta la exportación.

Principal ventaja: la combinación de una potente infraestructura y una rica tienda de scrapers listos.

No. 2. Octoparse — el constructor visual más comprensible para principiantes

Información General

Octoparse — plataforma popular en la nube y de escritorio para el scraping visual de sitios sin código. La empresa es originaria de China y ha estado activa en el mercado global desde mediados de la década de 2010. Especialización: interfaz visual, plantillas para escenarios comunes, configuración sencilla de acciones (clics, paginación, desplazamiento, entrada). Audiencia objetivo: mercadólogos, especialistas en contenidos, propietarios de pequeñas y medianas empresas que valoran un inicio rápido y una curva de aprendizaje mínima.

Características Clave

- Constructor visual: selección de elementos punto y clic, autogeneración de selectores XPath/CSS.

- Cloud Extraction: agentes en la nube ejecutan tareas sin una máquina local.

- Rotación IP incorporada, configuraciones anti-bots básicas, simulación de usuario (retrasos, desplazamiento).

- Renderizado JS a través de un navegador integrado, trabajando con páginas dinámicas.

- Exportación a CSV/JSON, Excel, Google Sheets; API; integraciones a través de Zapier/Make.

- Horarios de programación: diarios/semanales/por intervalo.

Características únicas: modo "Smart" para una rápida autocomposición de tablas desde páginas simples; biblioteca de plantillas para sitios populares; ricos guías y video tutoriales.

Especificaciones técnicas: runner en la nube estable, tareas paralelas en tarifas pagadas, soporte de autorización y scripts de captcha simples (a través de pistas y resolutores de terceros).

Integraciones: Google Sheets, Excel, API, Zapier/Make, bases de datos a través de exportaciones/scripts.

Tarifas y Precios

A enero de 2026, la matriz habitual: Free con limitaciones en velocidad/volumen; Standard alrededor de $75/mes; Professional alrededor de $209/mes; Enterprise — por consulta. Los minutos en la nube y la paralelización aumentan con el plan. Los proxies integrados se incluyen para lanzamientos en la nube; para tareas locales, se pueden conectar proxies externos. Relación precio/calidad excelente para principiantes y equipos sin soporte técnico.

Ventajas

- El mejorconstructor visual para un inicio rápido.

- Plantillas y materiales de formación que reducen significativamente el tiempo de configuración.

- Agentes en la nube y rotación IP integrada simplifican la operación.

- Exportación flexible y automatización a través de API y Zapier/Make.

- Ideal para tareas masivas en sitios de baja y mediana dificultad.

Desventajas

- Sitios con protecciones anti-bots complejas (fuerte Cloudflare, captchas difíciles) pueden requerir caminos alternativos y aun así fallar.

- Escenarios altamente personalizados a veces se ven limitados por el flujo visual.

- La optimización de un gran flujo de tareas requiere una cuidadosa configuración de horarios y límites.

Para Quién es Adecuado

Principiantes, pequeñas y medianas empresas, mercadólogos con tiempo limitado para la configuración; proyectos con volumen de datos regular, pero no extremo; scraping de catálogos, noticias, fichas de productos en sitios medianos donde la velocidad de implementación es clave.

Valoración por Criterios

- Funcionalidad: 8.5/10

- Precio: 8/10

- Usabilidad: 9/10

- Soporte: 8/10

- Reseñas: 8.3/10

- Valoración General: 8.5/10

⭐ Valoración General: 8.5/10

- Funcionalidad: 8.5/10

- Precio: 8/10

- Facilidad de Uso: 9/10

- Soporte Técnico: 8/10

- Reseñas de Usuarios: 8.3/10

✅ Mejor opción para: principiantes y equipos sin desarrolladores que buscan un resultado rápido sin código.

Principal ventaja: intuitivo constructor visual y biblioteca de plantillas.

No. 3. Browse AI — el inicio más rápido y cómodas integraciones con hojas de cálculo

Información General

Browse AI — herramienta en la nube, donde "entrenas" al robot para grabar acciones y seleccionar datos en la página, y luego lanzas monitoreos y exportaciones en integraciones. La empresa se enfoca en la simplicidad, velocidad y casos de negocios comunes: monitoreo de precios, seguimiento de fichas de productos, SERP, hojas de leads. Audiencia objetivo: mercadólogos, analistas de producto, propietarios de e-commerce y agencias.

Características Clave

- Entrenamiento por grabación: formación del robot con ejemplos en unos pocos clics.

- Navegadores en la nube, rotación IP básica; los robots pueden funcionar de acuerdo a un horario.

- Recetas listas para sitios y tareas populares.

- Exportación a Google Sheets "listo para usar", CSV/JSON a través de API y webhooks.

- Notificaciones y alertas al cambiar los datos.

Características únicas: máxima simplicidad para lanzar tareas a una audiencia no técnica; integración muy rápida con Google Sheets; gestión conveniente de robots y sus estados.

Especificaciones técnicas: cola en la nube y paralelismo están limitados por el plan; soporta autorización, flujos de clics, clic en paginación; sugerencias básicas anti-bots. Para sitios complejos, puede requerir ajustes finos de retrasos, plantillas y caminos alternativos.

Integraciones: Google Sheets, Slack/Email para notificaciones, API y webhooks, Zapier/Make para conexión con CRM/BI.

Tarifas y Precios

Modelo típico a enero de 2026: Free con limitaciones (varios robots, pequeños límites); Starter alrededor de $48/mes; Professional alrededor de $124/mes; Team alrededor de $249/mes; Enterprise — por consulta. Tenga en cuenta el concepto de "créditos" o "lanzamientos" de robots y límites en monitoreos; el costo final depende de la frecuencia de actualización y el número de páginas. Relación precio/calidad muy buena para tareas con una frecuencia de 1 a 4 veces al día y volúmenes moderados.

Ventajas

- Inicio super rápido: entrenamiento del robot toma minutos.

- Conexión ideal con Google Sheets y notificaciones.

- Bueno para SMB y departamentos de marketing con capacidad de pago.

- Recetas simples para tareas comunes (SERP, fichas de productos, monitoreo de precios).

- Reintentos automáticos y alertas ante fallos.

Desventajas

- Resistencia limitada contra sistemas anti-bots complejos.

- Menos flexible para escenarios muy personalizados en comparación con plataformas como Apify.

- Con el aumento de la frecuencia de monitoreo y páginas, el costo final puede aumentar considerablemente.

Para Quién es Adecuado

Mercadólogos, analistas, gerentes de producto, propietarios de pequeñas y medianas e-commerce; tareas donde la velocidad de lanzamiento, simplicidad de soporte y posibilidad de exportación clara a Sheets/API son esenciales.

Valoración por Criterios

- Funcionalidad: 8/10

- Precio: 8.5/10

- Usabilidad: 9.2/10

- Soporte: 7.8/10

- Reseñas: 8.5/10

- Valoración General: 8.4/10

⭐ Valoración General: 8.4/10

- Funcionalidad: 8/10

- Precio: 8.5/10

- Facilidad de Uso: 9.2/10

- Soporte Técnico: 7.8/10

- Reseñas de Usuarios: 8.5/10

✅ Mejor opción para: lanzamiento rápido de monitoreo de páginas y SERP con exportación a Sheets.

Principal ventaja: entrada mínima y cómodas integraciones.

No. 4. PhantomBuster — el mejor para redes sociales y generación de leads

Información General

PhantomBuster — plataforma en la nube para automatización y scraping enfocada en redes sociales y funnels de ventas. Proporciona "phantoms" — bots listos para LinkedIn, X, Instagram, Facebook, Google, entre otros. Fundada a finales de la década de 2010, está orientada a mercados globales. Público objetivo: equipos de SDR/BDR, mercadólogos de rendimiento, agencias que necesitan recopilar y enriquecer leads de redes sociales, lanzar outreach y automatizar acciones rutinarias.

Características Clave

- Amplia biblioteca de phantoms para redes sociales y Google: scraping de perfiles, publicaciones, comentaristas, seguidores; envíos y acciones automáticas dentro de lo permitido.

- Navegadores en la nube, rotación IP básica; soporte para conexión de proxies propios.

- Programación y cadenas de acciones; guardar sesiones para cuentas.

- Exportación a CSV/JSON, Google Sheets; API y webhooks.

- Notificaciones y recomendaciones anti-bloqueo (estrangulación y límites de plataformas).

Características únicas: especialización sólida para LinkedIn y otras redes sociales; combinación de scraping y automatización de outreach; pipelines estándar para generación de leads.

Especificaciones técnicas: limitaciones en "slots" y minutos de ejecución según el plan; soporte de imitación de comportamiento; resistencia a bloqueos depende de la higiene de las cuentas y escenarios.

Integraciones: Google Sheets, CRM a través de Zapier/Make y API; notificaciones.

Tarifas y Precios

A enero de 2026: Starter alrededor de $69/mes, Pro alrededor de $139/mes, Team alrededor de $399/mes, Enterprise — por consulta. El plan determina el número de phantoms, límites diarios de ejecución y paralelismo. La rotación IP integrada está presente, pero para casos complejos con redes sociales se recomienda usar BYO-proxy y cuidadosa configuración de la frecuencia de acciones. Para su nicho, buena relación costo-resultado.

Ventajas

- Mejor especialización para redes sociales y generación de leads.

- Phantoms listos para tareas clave en LinkedIn/X/Instagram.

- Buena integración con hojas de cálculo y CRM a través de Zapier/Make.

- Cadenas de acciones simples y planificación de campañas.

- Soporte para proxies externos para flexibilidad y resistencia.

Desventajas

- Especialización estrecha: en scraping web universal es menos eficiente que Apify y Octoparse.

- Riesgos de bloqueos en redes sociales por escenarios agresivos.

- Estructura de límites (slots/minutos) requiere adaptación.

Para Quién es Adecuado

Equipos de ventas, agencias de marketing, especialistas en outreach y SMM que necesitan flujos de leads de redes sociales y automatización de acciones dentro de las reglas de las plataformas.

Valoración por Criterios

- Funcionalidad: 8/10

- Precio: 7.5/10

- Usabilidad: 8.7/10

- Soporte: 8/10

- Reseñas: 8.2/10

- Valoración General: 8.1/10

⭐ Valoración General: 8.1/10

- Funcionalidad: 8/10

- Precio: 7.5/10

- Facilidad de Uso: 8.7/10

- Soporte Técnico: 8/10

- Reseñas de Usuarios: 8.2/10

✅ Mejor opción para: generación de leads de redes sociales y outreach.

Principal ventaja: máxima preparación para redes sociales y tipos estándar de procesos de ventas.

No. 5. Diffbot — el mejor para entidades estructuradas y búsqueda semántica

Información General

Diffbot — plataforma de extracción de IA con modelos de entidades listos (Artículo, Producto, Organización, etc.) y su propio Knowledge Graph. Lanzada a principios de la década de 2010 en EE.UU. Especialización: extracción automática de datos estructurados de páginas web sin necesidad de configurar selectores, búsqueda semántica y a texto completo a través del grafo de conocimiento. Público objetivo: investigadores de mercado, analistas corporativos, fintech y grandes empresas donde son clave la precisión de las entidades y acceso al grafo.

Características Clave

- Extracción basada en modelo: modelos listos para noticias, productos, empresas, etc.

- Knowledge Graph: acceso a un enorme grafo de datos web a través de API.

- Crawlbot y extracción automática, cumplimiento de robots por defecto.

- Respuestas en JSON con la estructura de entidades; integración a través de API.

- Posibilidad de reglas puntuales y personalización por dominio.

Características únicas: obtienes datos estructurados sin necesidad de capacitar selectores manualmente; escala a través del Knowledge Graph; potente búsqueda y agregación por entidades.

Especificaciones técnicas: infraestructura en la nube, alta resistencia a cambios en el formato gracias a ML; no está orientado a la evasión de anti-bots "a cualquier costo" — se enfoca en la recolección legal y calidad de los datos extraídos.

Integraciones: API, conectores a través de herramientas ETL, exportación a almacenes de datos a través de pipelines.

Tarifas y Precios

Se posiciona como solución de nivel "premium". A enero de 2026, orientación: Starter en torno a $299/mes, Plus/Enterprise — notablemente más caro. El precio depende del volumen de solicitudes, acceso al KG y conjunto de funciones. Para SMB, el presupuesto puede ser significativo; para corporaciones, está en consonancia con el valor de los datos. Generalmente no hay planes gratuitos, pero pueden existir demos/trials.

Ventajas

- Entidades listas: ahorro de tiempo en configuraciones y resistencia a cambios en HTML.

- Knowledge Graph: acceso a datos y relaciones únicas.

- Alta calidad en estructuración, útil para análisis e investigación.

- Enfoque API-first, se integra fácilmente en pipelines corporativos.

- Menos soporte manual en comparación con parsers basados en selectores.

Desventajas

- Precio alto para startups y SMB.

- Flexibilidad limitada para sitios no estándar y anti-bots "pesados".

- Enfoque en API/ML — para no-code requiere un nivel de integración adicional.

Para Quién es Adecuado

Empresas medianas y grandes, equipos analíticos y de investigación que valoran entidades estructuradas listas y acceso al grafo de conocimiento, más que desarrollar sus propios parsers.

Valoración por Criterios

- Funcionalidad: 8.7/10

- Precio: 6/10

- Usabilidad: 7.5/10

- Soporte: 8/10

- Reseñas: 8/10

- Valoración General: 7.7/10

⭐ Valoración General: 7.7/10

- Funcionalidad: 8.7/10

- Precio: 6/10

- Facilidad de Uso: 7.5/10

- Soporte Técnico: 8/10

- Reseñas de Usuarios: 8/10

✅ Mejor opción para: empresas que valoran entidades estructuradas listas y Knowledge Graph.

Principal ventaja: extracción ML de alta precisión sin necesidad de configurar selectores.

No. 6. ParseHub — parser visual confiable para tareas básicas y medianas

Información General

ParseHub — uno de los "veteranos" en el scraping visual, combinando un constructor de escritorio con ejecución en la nube y almacenamiento de resultados. Fundada a mediados de la década de 2010 en Canadá. Especialización: enfoque escénico claro (clics, paginación, extracción de listas), moderado soporte de dinámica. Público objetivo: usuarios que solo requieren una herramienta visual básica y exportación regular sin escenas complejas de anti-bots.

Características Clave

- Marcado visual de elementos, listas y paginación.

- Ejecutar en la nube con almacenamiento de resultados.

- Renderizado JS y manejo de páginas SPA simples.

- Exportación a CSV/JSON, Google Sheets a través de integraciones/scripts, API.

- Programación y monitoreo de tareas.

Características únicas: interfaz simple y comprobada con el tiempo; guías de formación para escenarios típicos.

Especificaciones técnicas: adecuada para proyectos pequeños y medianos; fuerte anti-bots y protecciones complejas de Cloudflare pueden ser un punto débil; requiere ajustes cuidadosos de retrasos y reintentos.

Integraciones: API, CSV/JSON, conectores a través de Zapier/Make.

Tarifas y Precios

A enero de 2026: Free con limitaciones; Standard alrededor de $189/mes; Professional alrededor de $499/mes; Enterprise — por consulta. Los límites se refieren a número de proyectos, tareas paralelas y velocidad. Relación precio/calidad justificada para escenarios conservadores, pero para sitios complejos podría ser necesario considerar otra herramienta.

Ventajas

- Enfoque visual comprobado y confiable.

- Es suficiente para muchas tareas básicas.

- Ejecutar en la nube, API y exportación a CSV/JSON.

- Documentación decente y comunidad.

- Adecuado para fines educativos y pilotos.

Desventajas

- Los sitios complejos con anti-bots son difíciles de manejar.

- La interfaz y arquitectura son menos flexibles que las de los líderes.

- El precio de Professional es comparable a soluciones más avanzadas.

Para Quién es Adecuado

Principiantes, pequeñas y medianas empresas, equipos pequeños que scrapean sitios simples, catálogos y páginas con mínima protección y no requieren alta frecuencia de actualización.

Valoración por Criterios

- Funcionalidad: 7.5/10

- Precio: 7/10

- Usabilidad: 7.8/10

- Soporte: 7.5/10

- Reseñas: 7.6/10

- Valoración General: 7.5/10

⭐ Valoración General: 7.5/10

- Funcionalidad: 7.5/10

- Precio: 7/10

- Facilidad de Uso: 7.8/10

- Soporte Técnico: 7.5/10

- Reseñas de Usuarios: 7.6/10

✅ Mejor opción para: pequeños proyectos y tareas educativas.

Principal ventaja: herramienta básica estable para scraping visual.

Tabla Comparativa

- Apify: fuerte anti-bots y proxies (residenciales/datos/SERP), tienda de Actors, exportación API/webhooks/Sheets, escalabilidad y programación a nivel empresarial. Precio: Free, Starter ~ $49, Team ~ $499, Business — individualmente. Ideal para marketplaces y SERP en grandes volúmenes.

- Octoparse: mejor constructor visual para principiantes, agentes en la nube y rotación de IP, exportación a Sheets/API, programación. Precio: Free, Standard ~ $75, Professional ~ $209. Ideal para un inicio rápido no-code en sitios simples/medianos.

- Browse AI: entrenamiento de robots mediante grabación, rápidas integraciones con Sheets, notificaciones, API/webhooks. Precio: Free, Starter ~ $48, Pro ~ $124, Team ~ $249. Ideal para monitoreo regular de páginas y SERP con baja complejidad en anti-bots.

- PhantomBuster: phantoms para redes sociales y Google, rotación IP, cadenas, Sheets/API. Precio: Starter ~ $69, Pro ~ $139, Team ~ $399. Mejor opción para generación de leads en redes sociales.

- Diffbot: extracción de entidades con ML, Knowledge Graph, enfoque API-first. Precio: desde ~$299/mes+. Ideal para análisis e investigación, donde son clave las entidades estructuradas.

- ParseHub: parser visual básico con ejecución en la nube, CSV/JSON/API. Precio: Free, Standard ~ $189, Professional ~ $499. Adecuado para tareas simples, pero un anti-bots complicado no es su punto fuerte.

Alternativas No Incluidas en el TOP

Vale la pena mencionar varias soluciones que son cercanas en funcionalidad, pero que en conjunto no superaron a los líderes.

- WebScraper.io Cloud: popular extensión con suscripción en la nube. Muy adecuada para casos educativos y tareas básicas, pero la resistencia a anti-bots y escalabilidad son inferiores a Apify y Octoparse.

- Bright Data Web Scraper: potente ecosistema de proxies y herramientas, pero para usar no-code se necesita más configuración, y el precio puede ser notable con volúmenes grandes.

- Zyte (ex-Scrapinghub) + Extracción Automática: plataforma y gestor de proxies fuerte, pero más dirigida a equipos técnicos y pipelines personalizados.

Recomendaciones de Selección

- Mejor para principiantes: Octoparse — el constructor visual más comprensible junto con sus plantillas.

- Mejor para profesionales: Apify — escala, proxies, resistencia a anti-bots, tienda de Actors.

- Mejor en precio: Browse AI en volúmenes pequeños/medianos con lanzamientos poco frecuentes y Sheets.

- Mejor en funcionalidad: Apify — stack completo y profundidad en configuración.

- Mejor para pequeñas empresas: Browse AI o Octoparse (inicio rápido, UX comprensible).

- Mejor para medianas empresas: Octoparse o Apify (dependiendo de la complejidad de los sitios y volúmenes).

- Mejor para grandes empresas: Apify o Diffbot (funciones empresariales, escala, SLA).

Escenarios individuales: para marketplaces (Wildberries, Ozon, Amazon) — Apify gracias a su Actors y proxies; Octoparse es adecuado para vitrinas simples y fichas sin protección agresiva. Para SERP — Apify (tiene scrapers listos con geotargeting), Browse AI — para monitoreo ligero y Sheets. Para redes sociales — PhantomBuster es indiscutiblemente el mejor en disponibilidad y automatización.

FAQ

¿Se puede hacer scraping de marketplaces sin bloqueos?

Excluir completamente los bloqueos no es posible, pero Apify con proxies residenciales y los retrasos adecuados reduce notablemente el riesgo. Octoparse y Browse AI son útiles para páginas menos protegidas. Cumple con las condiciones del sitio y la ética de uso.

¿Cuál plataforma es mejor para Wildberries y Ozon?

Apify — por sus Actors, proxies flexibles y resistencia. Para fichas simples — Octoparse. Verifica los aspectos legales y la frecuencia de solicitudes.

¿Qué elegir para monitoreo SERP?

Apify — por sus scrapers listos para SERP y geotargeting; Browse AI — por su simplicidad y Sheets; PhantomBuster — si necesitas combinar SERP con subsequent outreach.

¿Qué sistema es mejor para redes sociales?

PhantomBuster: phantoms listos, cadenas, exportación a CRM. Apify también puede, pero requerirá más configuración. Siempre ten en cuenta las reglas de las plataformas y utiliza límites seguros.

¿Se necesitan proxies propios?

Apify y PhantomBuster soportan BYO-proxies; Octoparse — para tareas locales; Browse AI y Diffbot generalmente trabajan con infraestructura integrada. Los proxies propios son necesarios en situaciones de anti-bots complicados o geos específicos.

¿Cómo elegir entre Octoparse y ParseHub?

Octoparse — más moderno visualmente y más amigable para principiantes; ParseHub — "clásico" para escenarios básicos. En sitios complejos, ambos no pueden competir con Apify.

¿Qué tan exactos son los precios?

Los precios se indican con base en enero de 2026 de acuerdo con fuentes públicas y ofertas típicas; verifica las condiciones actuales en tu cuenta, ya que promociones y límites cambian.

¿Hay límites en la frecuencia de lanzamientos?

Sí, todas las plataformas tienen límites en minutos/lanzamientos/créditos. Apify y Octoparse escalonan de manera flexible; Browse AI y PhantomBuster están limitados por el número de robots/phantoms y la frecuencia. Planifica tus horarios y distribuye la carga.

¿Se puede exportar directamente a BI?

Sí: a través de API y webhooks, así como conectores Zapier/Make y tablas intermedias. Apify — el más flexible; Diffbot — API-first; Octoparse y Browse AI — trabajan muy bien con Sheets.

¿Cómo evadir captchas?

Integra resolutores de captcha o reduce la frecuencia y aumenta la calidad de rotación. Apify ofrece pipelines personalizables e integraciones; en los demás — utiliza retrasos, gráficos y patrones "humanos".

Conclusión

Conclusiones del ranking: Apify — el mejor en función de parámetros: resistencia a anti-bots, proxies, ecosistema de Actors, escalabilidad e integraciones. Octoparse — el mejor para principiantes y SMB gracias a su constructor visual. Browse AI — el camino más rápido hacia el monitoreo con exportación a Google Sheets. PhantomBuster— el líder indiscutible para redes sociales y generación de leads. Diffbot — óptima para tareas analíticas grandes con entidades estructuradas listas. ParseHub — una herramienta básica confiable para escenarios simples.

Recomendaciones: para marketplaces (Wildberries, Ozon, Amazon) — Apify; para SERP — Apify o Browse AI; para redes sociales — PhantomBuster; para proyectos analíticos profundos y semántica — Diffbot; para un rápido inicio no-code — Octoparse; para tareas educativas y básicas — ParseHub. Recuerda la legalidad y política de los sitios; planifica la carga y utiliza proxies de rotación.

Tendencias 2024–2025, vigentes en 2026: aumento del papel de plantillas listos y asistentes de IA en la configuración de scrapers, convergencia del scraping con la automatización de procesos de outreach y pipelines de datos, intensificación de protecciones anti-bots y complejidad de evasión sin rotación de IP de calidad y emulación conductual. En los próximos años, espera más configuraciones impulsadas por AI, recomendaciones automáticas sobre resistencia y modos de recolección de datos "policy-aware" que consideren aspectos legales por adelantado.

Artículo preparado en enero de 2026. Verifica tarifas y límites actuales en tus cuentas: los proveedores actualizan regularmente sus líneas y condiciones.